普林斯顿DeepMind用数学证明:LLM不是随机鹦鹉!「规模越大能力越强」有理论根据

普林斯顿DeepMind用数学证明:LLM不是随机鹦鹉!「规模越大能力越强」有理论根据普林斯顿大学和DeepMind的科学家用严谨的数学方法证明了大语言模型不是随机鹦鹉,规模越大能力一定越大。

搜索

搜索

普林斯顿大学和DeepMind的科学家用严谨的数学方法证明了大语言模型不是随机鹦鹉,规模越大能力一定越大。

检索增强生成(RAG)和微调(Fine-tuning)是提升大语言模型性能的两种常用方法,那么到底哪种方法更好?在建设特定领域的应用时哪种更高效?微软的这篇论文供你选择时进行参考。

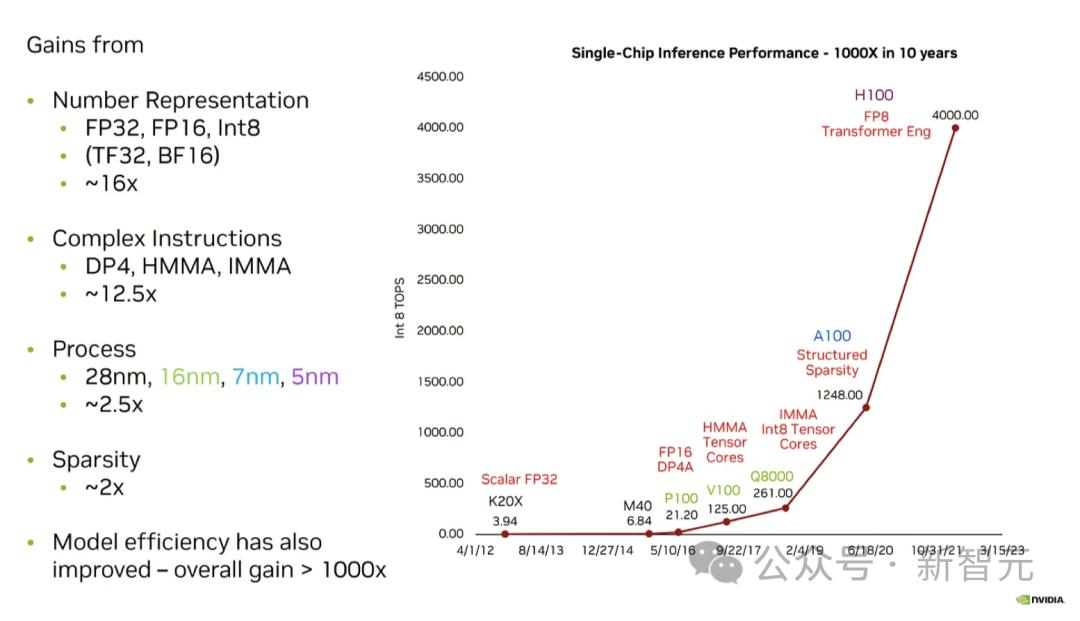

为了应对大模型不断复杂的推理和训练,英伟达、AMD、英特尔、谷歌、微软、Meta、Arm、高通、MatX以及Lemurian Labs,纷纷开始研发全新的硬件解决方案。

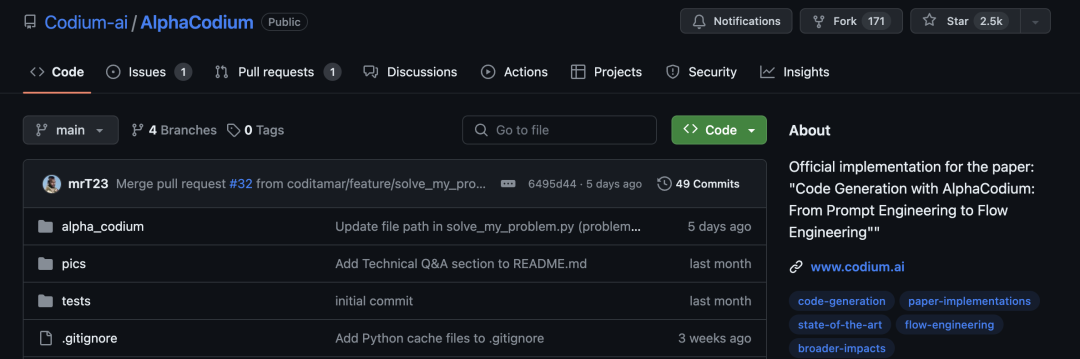

Karpathy力推代码生成任务增强流程,让GPT-4在CodeContests从19%提升到44%,不用微调不用新数据集训练,让大模型代码能力大幅提升。

奥特曼称,OpenAI计划将部分大模型开源,还谈到了GPT-5。他称人工智能将“像手机一样”改变世界,OpenAI将开源更多大模型,ChatGPT 5将变得更加智能,同时呼吁将阿联酋打造为全球监管人工智能的试验场。

人工智能诈骗已成现实,引人忧虑。近几个月来,人工智能接连浮现,我们频繁在新闻标题中看到如下字眼:AI 泄露了公司代码,还根本就删不掉;AI 软件侵犯了用户的人脸信息隐私;某大模型产品被曝泄露私密对话……等等。

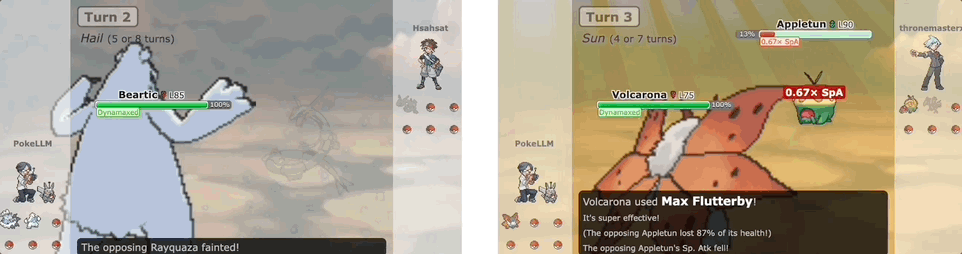

基于大模型的Agent会玩宝可梦了,人类水平的那种!名为PokéLLMon,现在它正在天梯对战中与人类玩家一较高下:

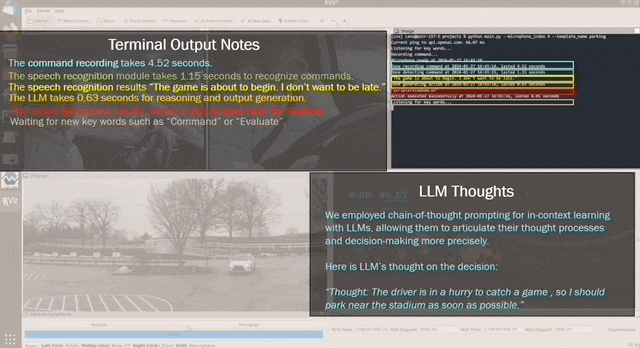

现在一句口令,就能指挥汽车了。比如说声“我开会要迟到了”“我不想让我朋友等太久”等等,车就能理解,并且自动加速起来。

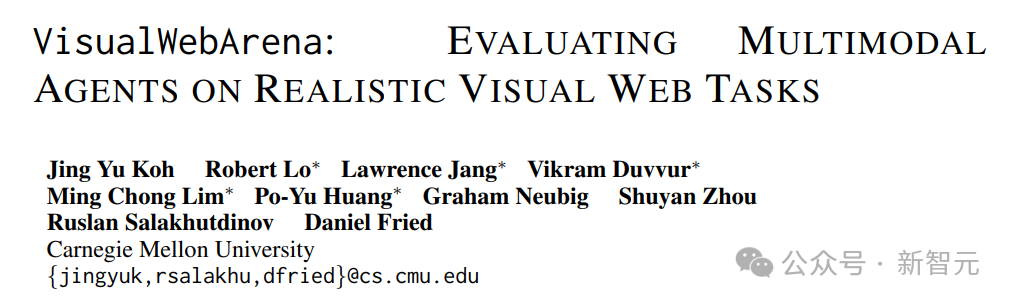

大模型的新考验来了!近日,来自卡内基梅隆大学的研究人员发布了评估LLM多模态Web代理性能的基准测试。

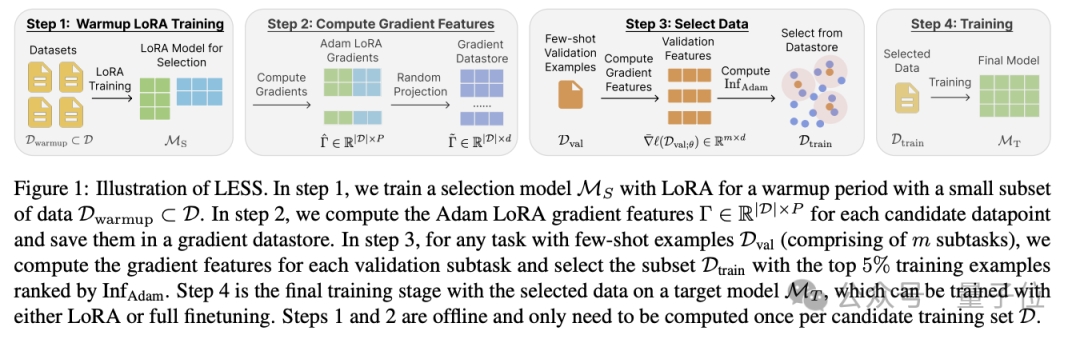

造大模型的成本,又被打下来了!这次是数据量狂砍95%的那种。陈丹琦团队最新提出大模型降本大法——数据选择算法LESS, 只筛选出与任务最相关5%数据来进行指令微调,效果比用整个数据集还要好。