在对齐 AI 时,为什么在线方法总是优于离线方法?

在对齐 AI 时,为什么在线方法总是优于离线方法?在线和离线对齐算法的性能差距根源何在?DeepMind实证剖析出炉

来自主题: AI资讯

10729 点击 2024-05-19 16:20

搜索

搜索

在线和离线对齐算法的性能差距根源何在?DeepMind实证剖析出炉

“Scaling Law不是万金油”——关于大模型表现,华为又提出了新理论。

近年来,定制化的人物生成技术在社区中引起了广泛关注。

谷歌表示,Gemini 1.5 相比 Claude 3.0 和 GPT-4 Turbo 实现了代际提升。

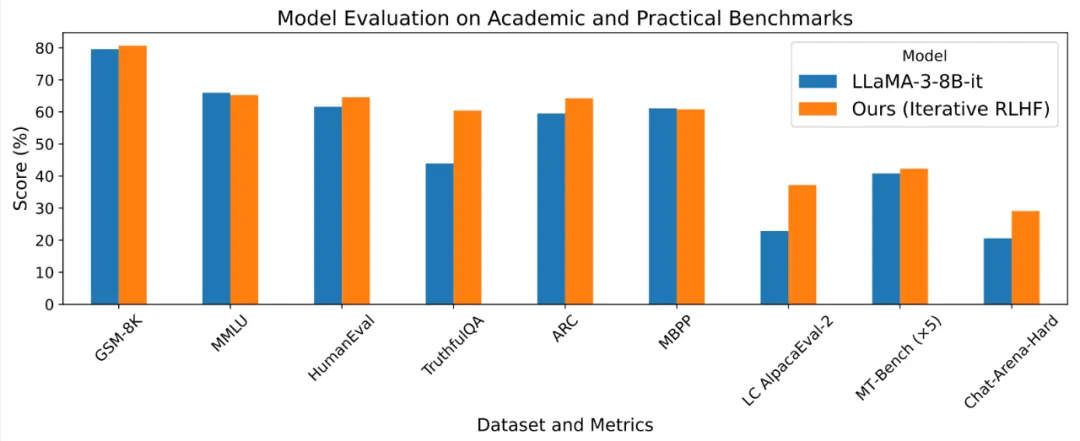

基于人类反馈的强化学习 (RLHF) 使得大语言模型的输出能够更加符合人类的目标、期望与需求,是提升许多闭源语言模型 Chat-GPT, Claude, Gemini 表现的核心方法之一。

本周,生成式 AI 的竞争达到了新的高潮。

前有OpenAI的GPT-4o,后有谷歌的系列王炸,先进的多模态大模型接连炸场。

最近一周KAN的热度逐渐褪去,正好静下心来仔细学习KAN的原理,收获颇多。

生成式AI时代,数据编织将成为下一代数据管理的主流范式。

在大型语言模型的训练过程中,数据的处理方式至关重要。