深度|打破次元边界,Xmax AI发布世界首个虚实融合的实时交互视频模型X1,开启视频交互新范式

深度|打破次元边界,Xmax AI发布世界首个虚实融合的实时交互视频模型X1,开启视频交互新范式如果 2024 年我们还在感叹 Sora 模拟物理世界的真实感,那么在 2026 年的今天,单纯的高清视频生成已不再是终点。

如果 2024 年我们还在感叹 Sora 模拟物理世界的真实感,那么在 2026 年的今天,单纯的高清视频生成已不再是终点。

明明可以去抢,他们却给了你更好的模型?

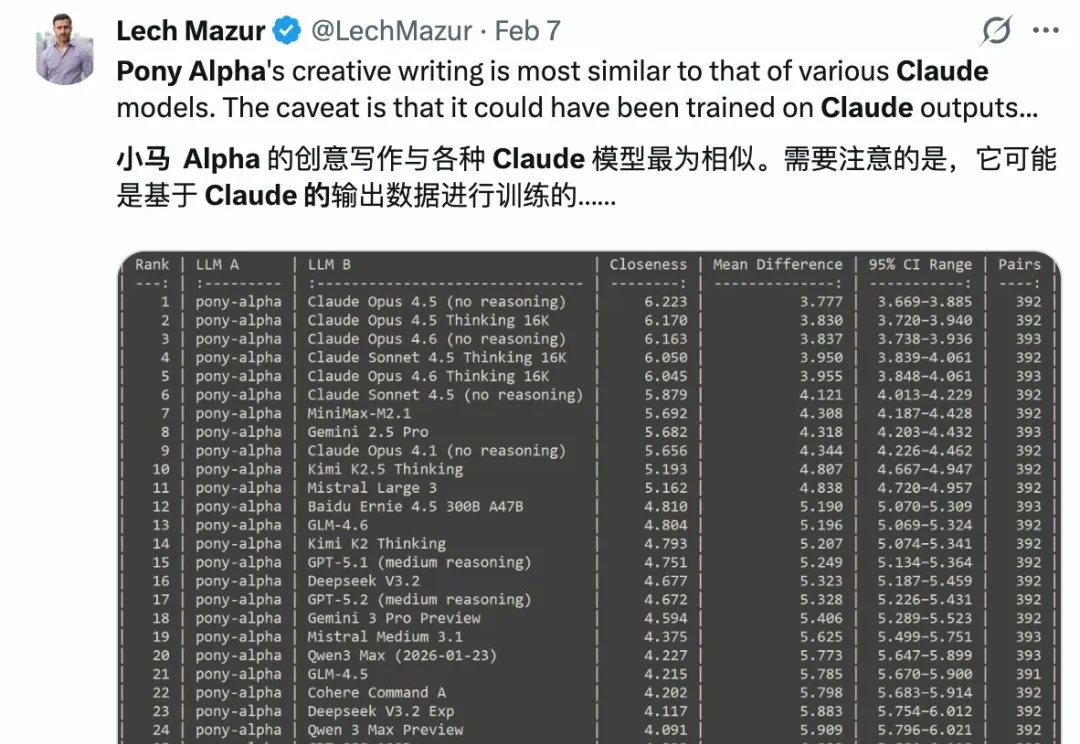

马年未至,春节档新模型已经蓄势待发。

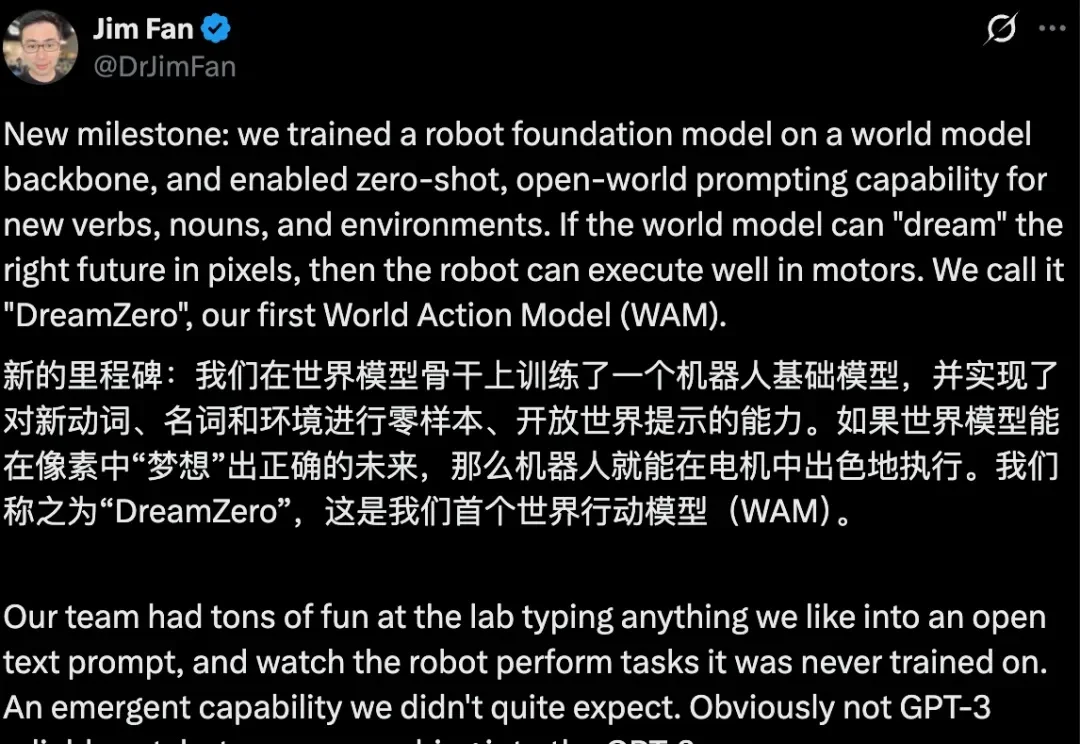

驱动具身智能进入通用领域最大的问题在哪里?

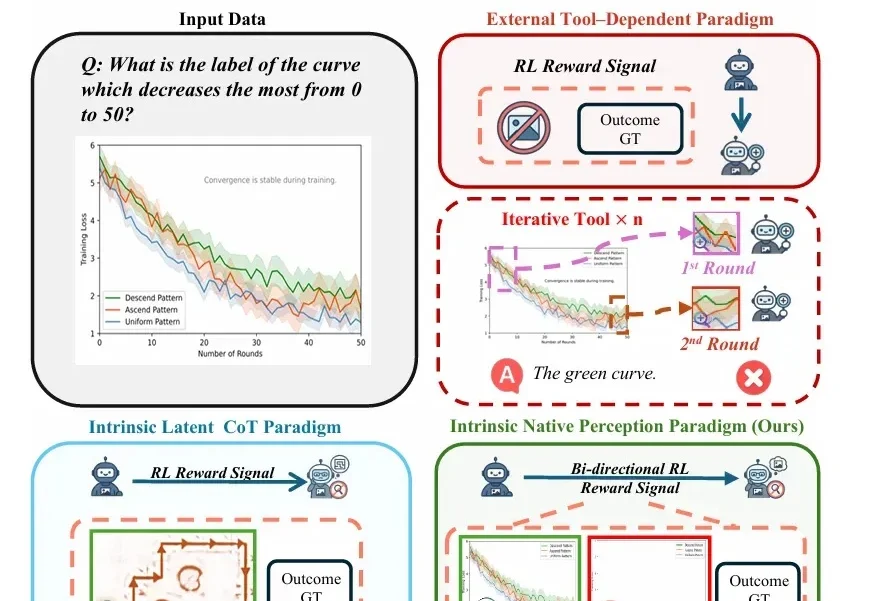

随着视觉-语言模型(VLM)推理能力不断增强,一个隐蔽的问题逐渐浮现: 很多错误不是推理没做好,而是“看错了”。

在大模型驱动的 Agentic Search 日益常态化的背景下,真实环境中智能体 “如何发查询、如何改写、是否真正用上检索信息” 一直缺乏系统刻画与分析。

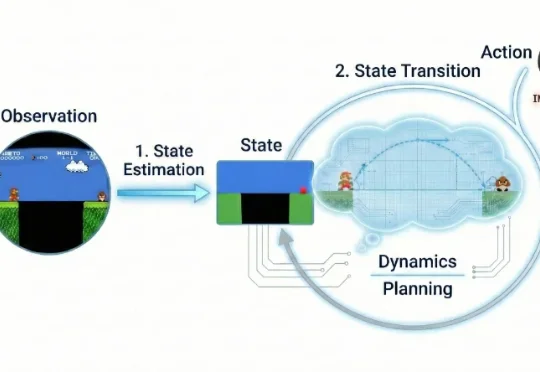

近年来,视频生成(Video Generation)与世界模型(World Models)已跃升为人工智能领域最炙手可热的焦点。从 Sora 到可灵(Kling),视频生成模型在运动连续性、物体交互与部分物理先验上逐渐表现出更强的「世界一致性」,让人们开始认真讨论:能否把视频生成从「逼真短片」推进到可用于推理、规划与控制的「通用世界模拟器」。

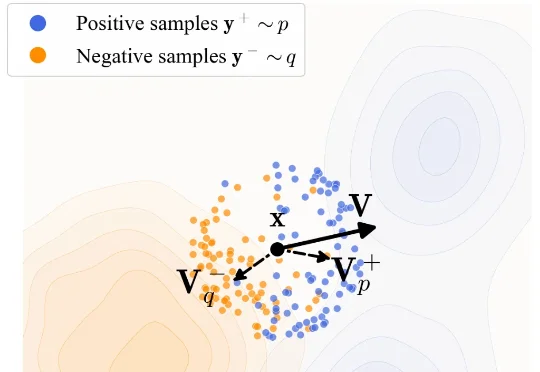

训练一个生成模型是很复杂的一件事儿。 从底层逻辑上来看,生成模型是一个逐步拟合的过程。与常见的判别类模型不同,判别类模型通常关注的是将单个样本映射到对应标签,而生成模型则关注从一个分布映射到另一个分布。

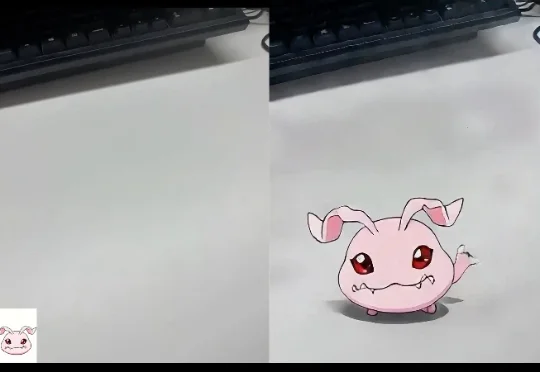

初创公司 Xmax AI 推出的首个虚实融合的实时交互视频模型 X1,没有复杂的 Prompt,不需要漫长的渲染等待,只需要手势进行交互,就可以让虚拟世界与现实相连,在镜头中令「幻想」成真,让用户体验到实时交互的心流体验。

大规模表格模型(LTM)而非大规模语言模型(LLM)的 Fundamental 公司 Nexus 模型,在多个重要方面突破了当代人工智能实践。该模型具有确定性——即每次被询问相同问题时都会给出相同答案——且不依赖定义当代大多数人工智能实验室模型的 Transformer 架构 。