超过o1-mini、逼近o3-mini,DeepSeek-R1在新的贪吃蛇基准上拿下1801分

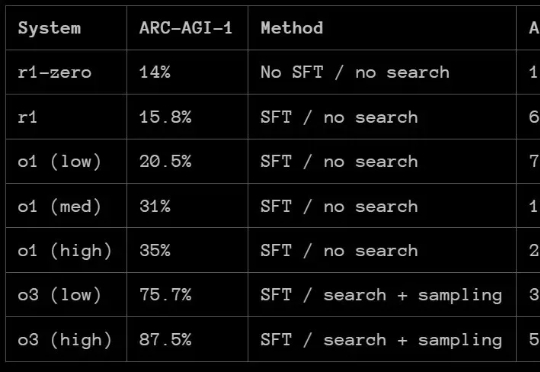

超过o1-mini、逼近o3-mini,DeepSeek-R1在新的贪吃蛇基准上拿下1801分那么,DeepSeek-R1 的 ARC-AGI 成绩如何呢?根据 ARC Prize 发布的报告,R1 在 ARC-AGI-1 上的表现还赶不上 OpenAI 的 o1 系列模型,更别说 o3 系列了。但 DeepSeek-R1 也有自己的特有优势:成本低。

搜索

搜索

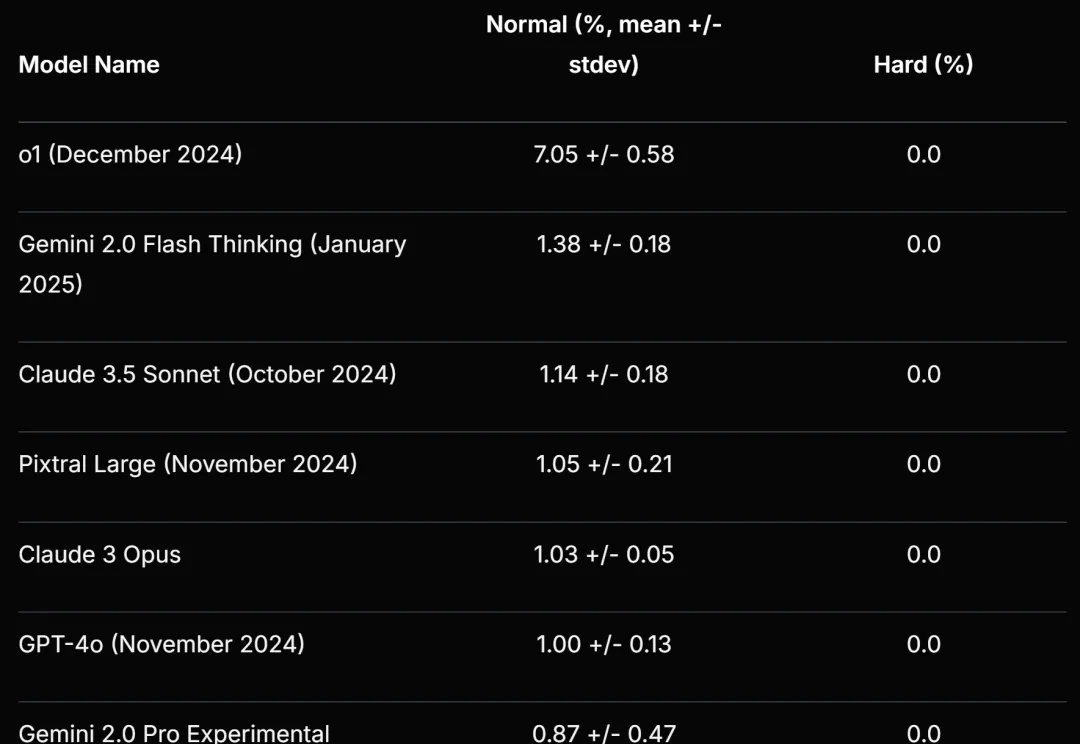

那么,DeepSeek-R1 的 ARC-AGI 成绩如何呢?根据 ARC Prize 发布的报告,R1 在 ARC-AGI-1 上的表现还赶不上 OpenAI 的 o1 系列模型,更别说 o3 系列了。但 DeepSeek-R1 也有自己的特有优势:成本低。

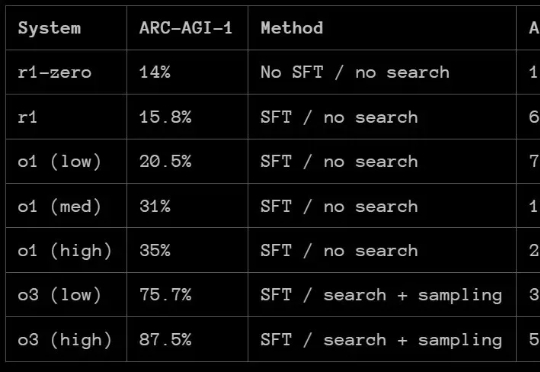

尽管多模态大模型在通用视觉理解任务中表现出色,但不具备细粒度视觉识别能力,这极大制约了多模态大模型的应用与发展。针对这一问题,北京大学彭宇新教授团队系统地分析了多模态大模型在细粒度视觉识别上所需的 3 项能力:对象信息提取能力、类别知识储备能力、对象 - 类别对齐能力,发现了「视觉对象与细粒度子类别未对齐」

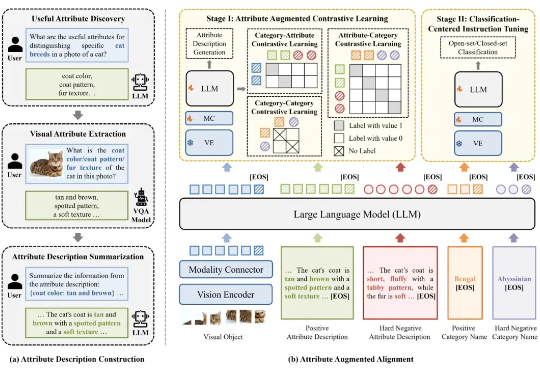

Anthropic,公布了新的AI模型防护方法,在之后约48小时内,无人完全攻破新系统,将赏金提高到了最高2万美元。新方法真这么强?

GPT-4o悄悄更新版本,在大模型竞技场超越DeepSeek-R1登上并列第一。

2025年,中国大模型迎来最高光时刻。DeepSeek凭借深度推理、低成本强势崛起,中科院系AI企业祭出的YAYI-Ultra大模型在代码能力上超越GPT-4o,成功跻身OpenCompas榜单全球前十,高精度和低能耗兼而有之。

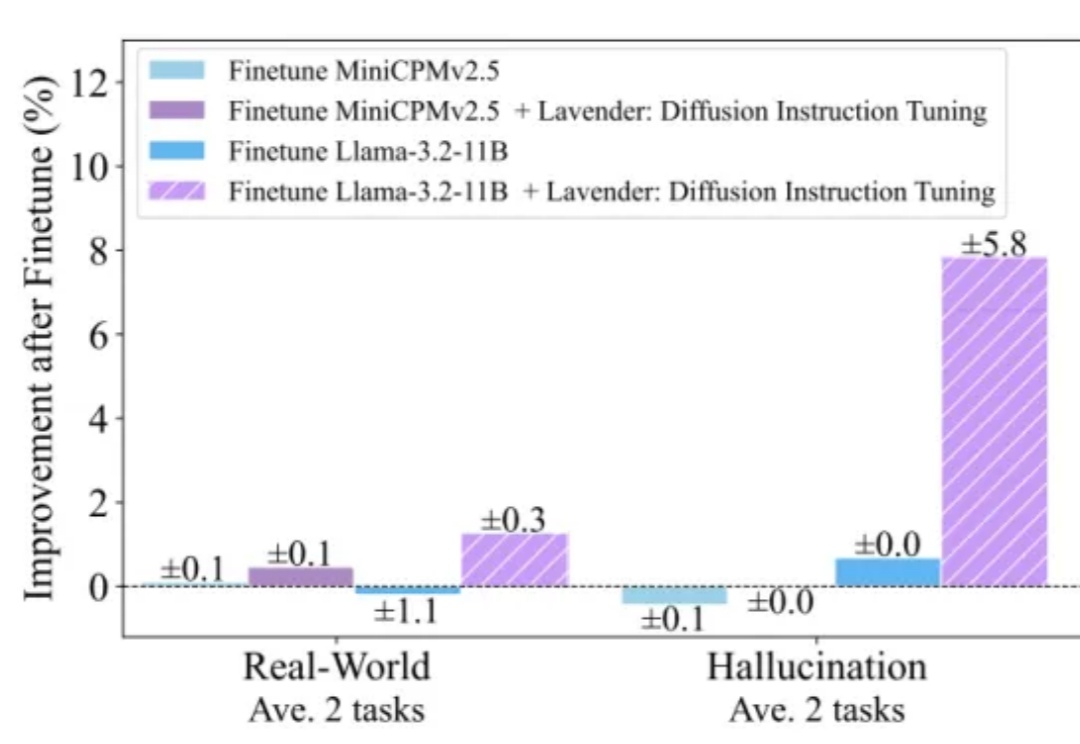

Scale AI 等提出的新基准再次暴露了大语言模型的弱点。

这次不是卷参数、卷算力,而是卷“跨界学习”——

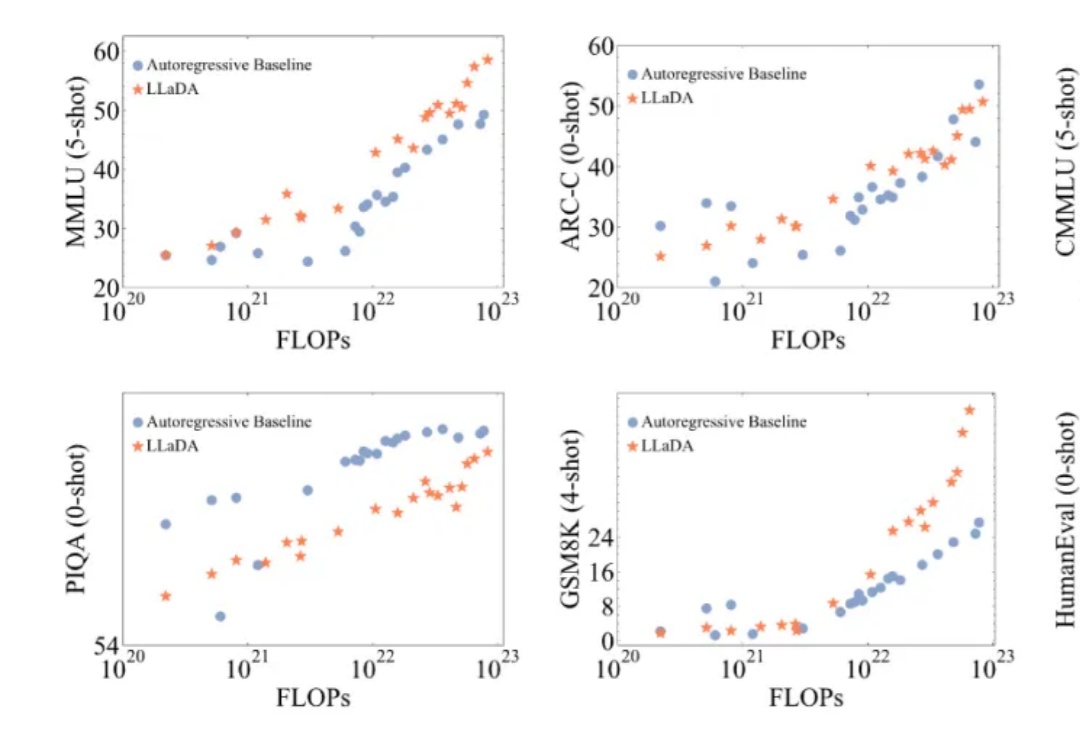

近年来,大语言模型(LLMs)取得了突破性进展,展现了诸如上下文学习、指令遵循、推理和多轮对话等能力。目前,普遍的观点认为其成功依赖于自回归模型的「next token prediction」范式。

人工智能科学家吴恩达指出,AI的浪潮将席卷各行各业,催生「10倍专业人士」!这不仅仅是效率的提升,更是工作方式的变革。本文将深入解读AI如何赋能职场,揭示成为「10倍人才」的秘诀!

广东打响了第一枪。深圳龙岗区的政务系统悄悄上线了DeepSeek-R1全尺寸模型,群众办事时面对的不再是机械的问答机器人,而是一个能理解“我想办落户,但社保断了3个月怎么办”这类复杂问题的AI公务员。东莞紧随其后,把DeepSeek塞进了人工智能大模型中心,号称要让“企业办证速度跑赢奶茶外卖”。更狠的是广州,直接祭出DeepSeek-R1和V3 671B双模型组合