大模型「记忆断片」成历史!AI初创全新Zep系统,知识图谱破解上下文诅咒

大模型「记忆断片」成历史!AI初创全新Zep系统,知识图谱破解上下文诅咒Zep,一个为大模型智能体提供长期记忆的插件,能将智能体的记忆组织成情节,从这些情节中提取实体及其关系,并将它们存储在知识图谱中,从而让用户以低代码的方式为智能力构建长期记忆。

搜索

搜索

Zep,一个为大模型智能体提供长期记忆的插件,能将智能体的记忆组织成情节,从这些情节中提取实体及其关系,并将它们存储在知识图谱中,从而让用户以低代码的方式为智能力构建长期记忆。

在AI行业新诞生的「多模态交互」赛道上,声网发布的「对话式AI引擎」,让所有文本大模型秒变多模态,具备实时语音对话能力,补齐了大模型「失语」的短板。

目前的 AI 行业,除了大模型外,竞争最激烈的可能就是 AI 编程了。昨天的文章《用 AI 解决专利纠纷半年 ARR 增 20 倍,Anthropic 再融 35 亿美金》里我还调侃 AI 编程正在经历百编大战,没想到今天这个行业又来了一些新消息。

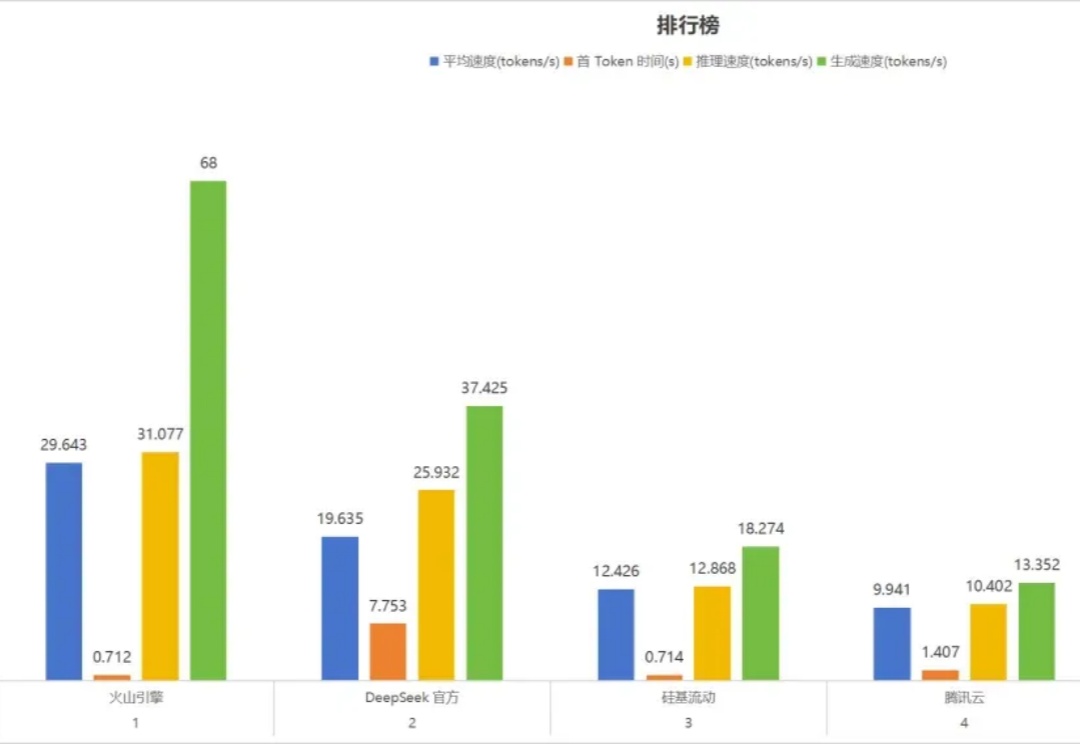

部署 DeepSeek 系列模型,尤其是推理模型 DeepSeek-R1,已经成为一股不可忽视的潮流。

开源模型,还是得看杭州。

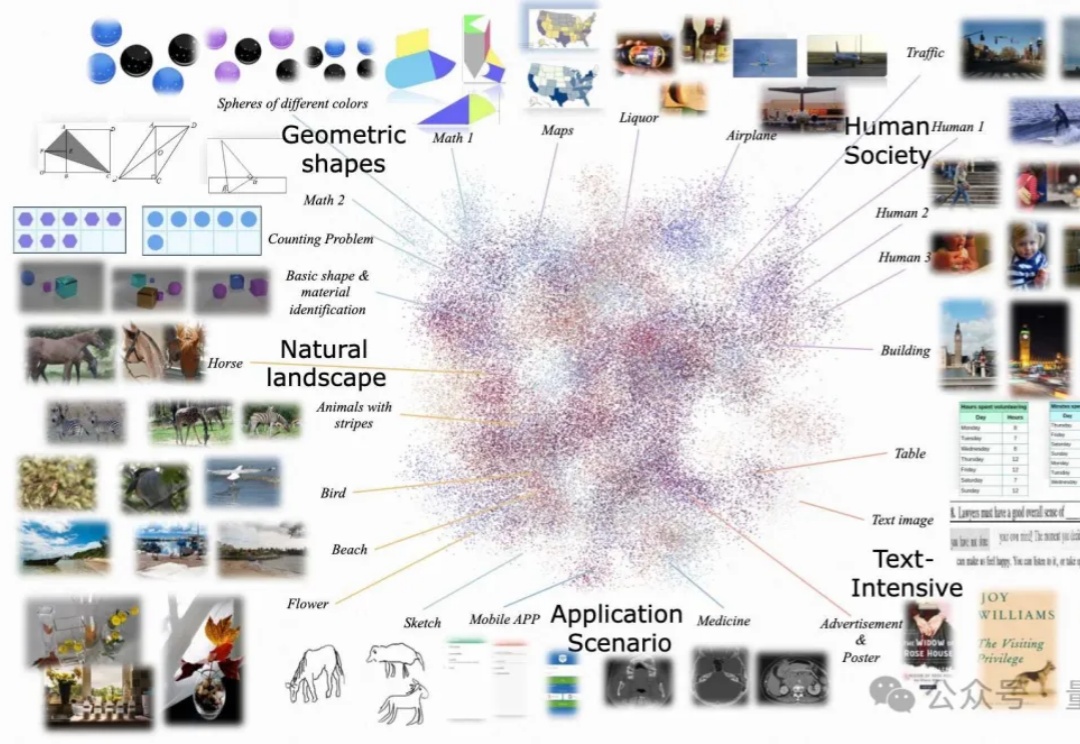

尽管多模态大语言模型(MLLMs)取得了显著的进展,但现有的先进模型仍然缺乏与人类偏好的充分对齐。这一差距的存在主要是因为现有的对齐研究多集中于某些特定领域(例如减少幻觉问题),是否与人类偏好对齐可以全面提升MLLM的各种能力仍是一个未知数。

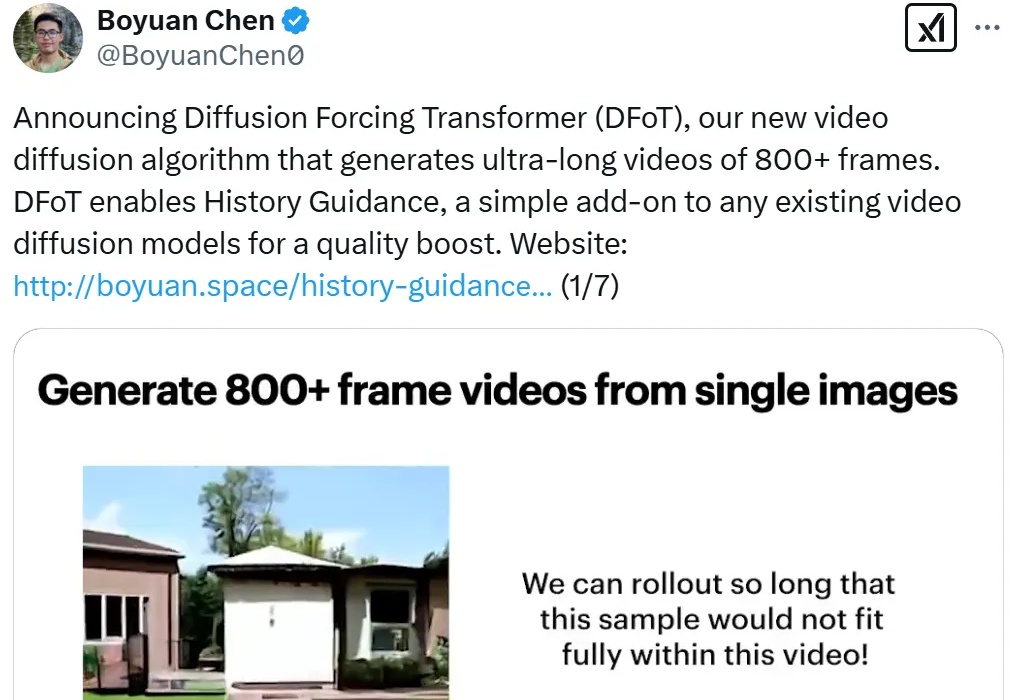

进入到 2025 年,视频生成(尤其是基于扩散模型)领域还在不断地「推陈出新」,各种文生视频、图生视频模型展现出了酷炫的效果。其中,长视频生成一直是现有视频扩散的痛点。

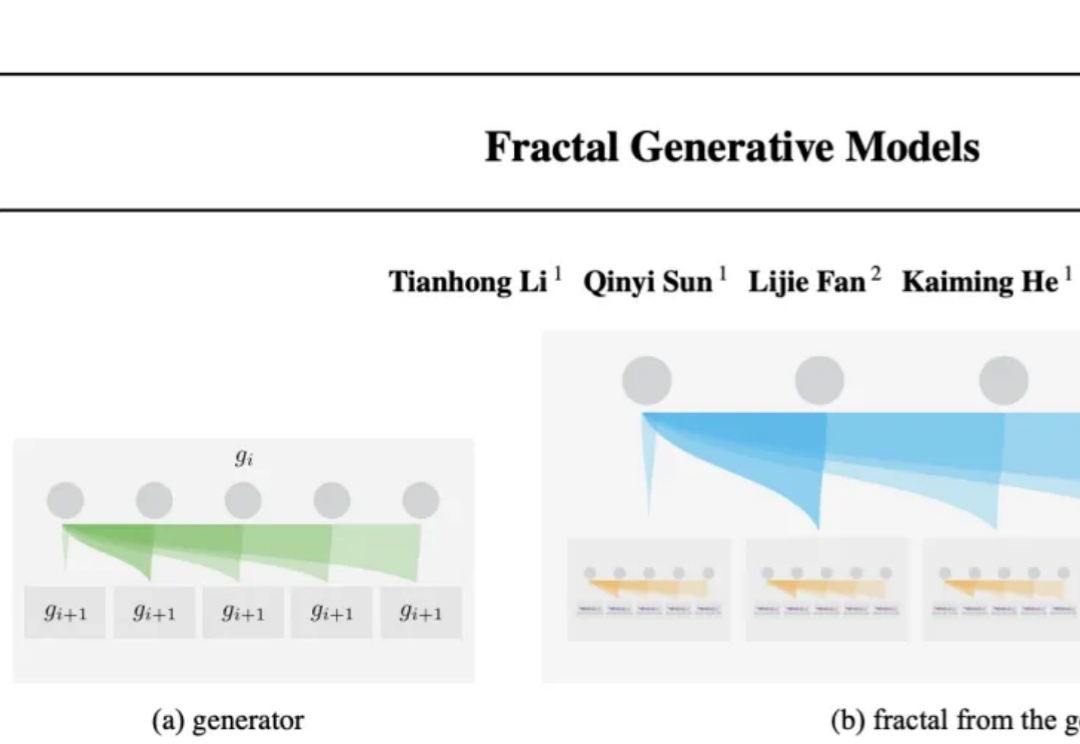

何恺明再次开宗立派!开辟了生成模型的全新范式——

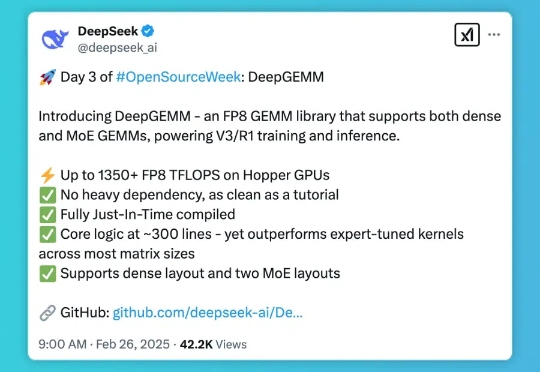

DeepSeek 的开源周已经进行到了第三天(前两天报道见文末「相关阅读」)。今天开源的项目名叫 DeepGEMM,是一款支持密集型和专家混合(MoE)GEMM 的 FP8 GEMM 库,为 V3/R1 的训练和推理提供了支持,在 Hopper GPU 上可以达到 1350+ FP8 TFLOPS 的计算性能。

DeepSeek 开源周的第三天,带来了专为 Hopper 架构 GPU 优化的矩阵乘法库 — DeepGEMM。这一库支持标准矩阵计算和混合专家模型(MoE)计算,为 DeepSeek-V3/R1 的训练和推理提供强大支持,在 Hopper GPU 上达到 1350+FP8 TFLOPS 的高性能。