后训练时代如何延续Scaling Law?这是你该读的LLM后训练综述

后训练时代如何延续Scaling Law?这是你该读的LLM后训练综述现如今,微调和强化学习等后训练技术已经成为提升 LLM 能力的重要关键。

搜索

搜索

现如今,微调和强化学习等后训练技术已经成为提升 LLM 能力的重要关键。

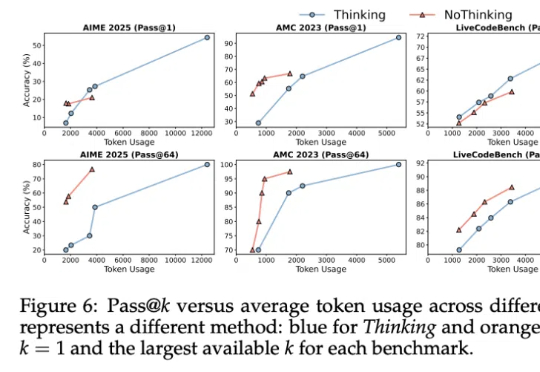

其实……不用大段大段思考,推理模型也能有效推理!

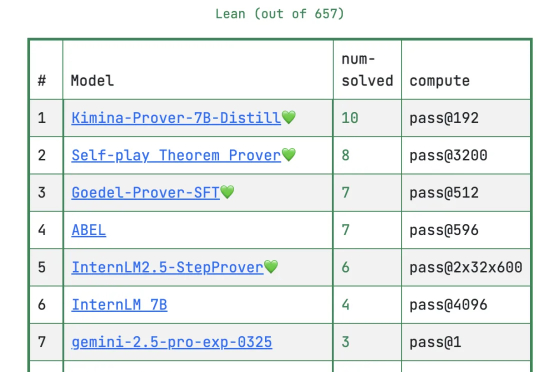

DeepSeek放大招!新模型专注数学定理证明,大幅刷新多项高难基准测试。在普特南测试上,新模型DeepSeek-Prover-V2直接把记录刷新到49道。目前的第一名在657道题中只做出10道题,为Kimi与AIME2024冠军团队Numina合作成果Kimina-Prover。

4月29日,习近平总书记在上海考察时,在中共中央政治局委员、上海市委书记陈吉宁和市长龚正陪同下,来到位于徐汇区的上海“模速空间”大模型创新生态社区调研。

2025年4月29日凌晨,距离通义千问Qwen3正式发布还有5小时,X和GitHub上的开发者们已经搬好小板凳蹲守发布。开源社区的技术爱好者们熬夜刷新,等待第一时间测试和体验这款备受期待的中国大模型新作。

来自英伟达和UIUC的华人团队提出一种高效训练方法,将LLM上下文长度从128K扩展至惊人的400万token SOTA纪录!基于Llama3.1-Instruct打造的UltraLong-8B模型,不仅在长上下文基准测试中表现卓越,还在标准任务中保持顶尖竞争力。

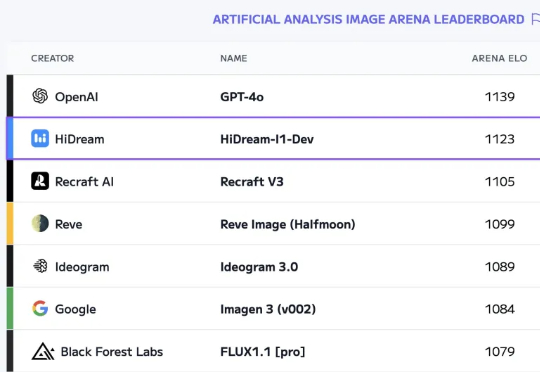

我又发现好东西了!前几天在 Artificial Analysis 上发现了一个新模型:17B 参数的国产模型 HiDream-I1排到第二名,和 GPT-4o 得分非常接近!

就在刚刚,DeepSeek-Prover-V2技术报告也来了!34页论文揭秘了模型的训练核心——递归+强化学习,让数学推理大提升。有人盛赞:DeepSeek已找到通往AGI的正确路径!

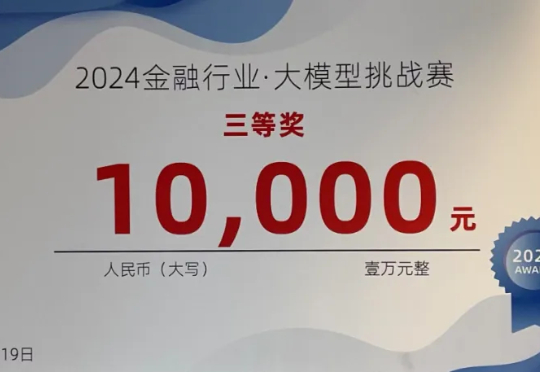

由智谱和清华大学联合举办的“地狱级”黑客松 -《2024金融行业·大模型挑战赛》。该黑客松颇为艰困,完全复刻了金融行业二级市场的真实需求。而经过数月奋战,我,作为一名金融市场“门外汉”,在1300+名选手中“杀出一条血路”,最终获得了全国第七名以及10,000元的奖金。

宇曜科技Matter-seek:用AI重构材料科学研发新范式。在高端制造领域,新材料研发的滞后性正成为制约产业升级的隐形瓶颈——光刻胶、航空发动机高温合金等核心材料长期依赖进口,单一材料研发周期动辄十年起步,失败率居高不下。宇曜(北京)科技有限公司推出的Matter-seek人工智能新材料研发平台,正试图用“数据引擎+层级神经网络”的技术组合,打破这一僵局。