人大高瓴-华为诺亚:大语言模型智能体记忆机制的系列研究

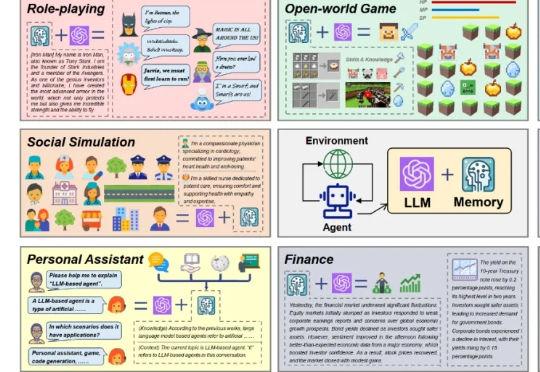

人大高瓴-华为诺亚:大语言模型智能体记忆机制的系列研究近期,基于大语言模型的智能体(LLM-based agent)在学术界和工业界中引起了广泛关注。对于智能体而言,记忆(Memory)是其中的重要能力,承担了记录过往信息和外部知识的功能,对于提高智能体的个性化等能力至关重要。

近期,基于大语言模型的智能体(LLM-based agent)在学术界和工业界中引起了广泛关注。对于智能体而言,记忆(Memory)是其中的重要能力,承担了记录过往信息和外部知识的功能,对于提高智能体的个性化等能力至关重要。

疑似GPT-5发布的预告才刚刚发出,内测体验已抢先释出。 推理能力首次超越人类,碾压所有大模型。

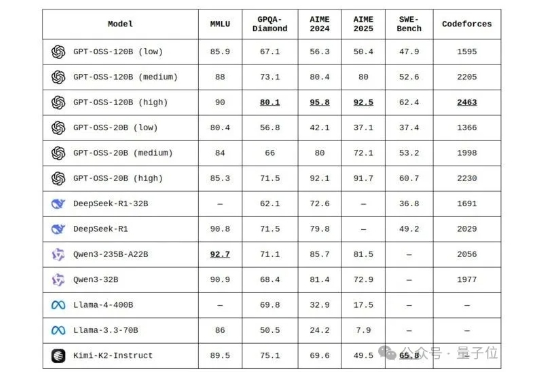

今天 ,OpenAI 开源了俩模型:120B/20B 117B 的 gpt-oss-120b 对标 o4-min,按官方说法至少需要 80G 内存,推荐使用单卡 H100 GPU 而刚买的的游戏本,刚好满足gpt-oss-120b 的部署条件

过去,对于普通人来说,考试几乎决定一切。「优绩主义」的单一评判体系在无形中将社会分层。而今天,AI 已经比绝大多数人更有用了,当 AI 用一元钱的成本,完成一个人类博士的工作时,曾经代表「自我价值」的学历、职位、履历..... 正开始失效。

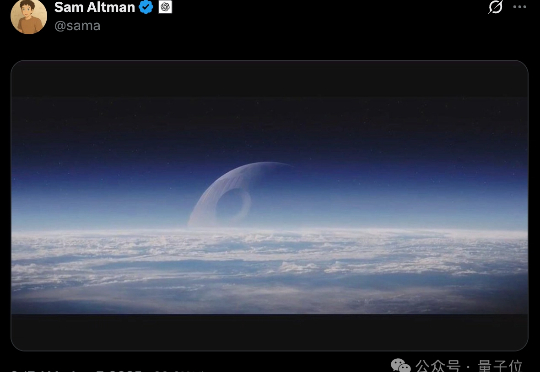

大部分现有的文档检索基准(如MTEB)只考虑了纯文本。而一旦文档的关键信息蕴含在图表、截图、扫描件和手写标记中,这些基准就无能为力。为了更好的开发下一代向量模型和重排器,我们首先需要一个能评测模型在视觉复杂文档能力的基准集。

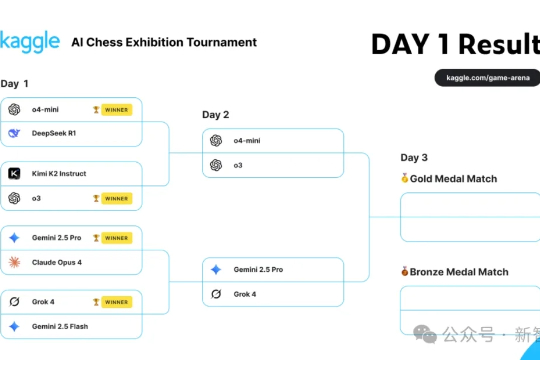

第二轮首届大模型对抗赛结果出炉了!o3轻而易举击败o4-mini,拿下100%胜率。Grok 4和Gemini 2.5 Pro激烈对决,最终在加赛中Grok 4成功晋级。明日,Grok 4和o3将迎来终局之战。

全网开扒GPT-oss,惊喜发现…… 奥特曼还是谦虚了,这性能岂止是o4-mini的水平,直接SOTA击穿一众开源模型。

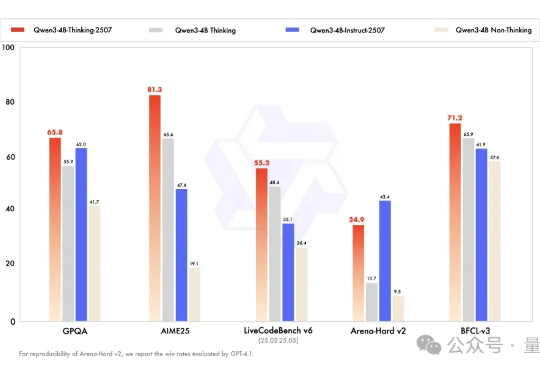

三天不开源,Qwen团队手就痒。 昨天深夜再次放出两个端侧模型: Qwen3-4B-Instruct-2507:非推理模型,大幅提升通用能力 Qwen3-4B-Thinking-2507:高级推理模型,专为专家级任务设计

AI国际象棋对抗?这次玩真的!谷歌Kaggle推出首届全球AI象棋争霸赛,八款顶级语言模型正面对抗,胜负只在一步之间!

你有没有发现,AI 应用生成平台们正在走向一条与大家预期完全不同的路?很多人原本以为这会是一场血腥的零和游戏,大家会在价格战中厮杀到底,最终只剩一家独大。但现实却让人意外:这些平台不但没有互相厮杀,反而开始各自寻找差异化的定位,在不同的细分市场中共存共荣。这让我想起了大语言模型市场的发展轨迹,同样出人意料,同样充满启发。