将KV Cache预算降至1.5%!他们用进化算法把大模型内存占用砍下来了

将KV Cache预算降至1.5%!他们用进化算法把大模型内存占用砍下来了只用 1.5% 的内存预算,性能就能超越使用完整 KV cache 的模型,这意味着大语言模型的推理成本可以大幅降低。EvolKV 的这一突破为实际部署中的内存优化提供了全新思路。

只用 1.5% 的内存预算,性能就能超越使用完整 KV cache 的模型,这意味着大语言模型的推理成本可以大幅降低。EvolKV 的这一突破为实际部署中的内存优化提供了全新思路。

挑战自回归的扩散语言模型刚刚迎来了一个新里程碑:蚂蚁集团和人大联合团队用 20T 数据,从零训练出了业界首个原生 MoE 架构扩散语言模型 LLaDA-MoE。该模型虽然激活参数仅 1.4B,但性能可以比肩参数更多的自回归稠密模型 Qwen2.5-3B,而且推理速度更快。这为扩散语言模型的技术可行性提供了关键验证。

本周五,Meta AI 团队正式发布了 MobileLLM-R1。 这是 MobileLLM 的全新高效推理模型系列,包含两类模型:基础模型 MobileLLM-R1-140M-base、MobileLLM-R1-360M-base、MobileLLM-R1-950M-base 和它们相应的最终模型版。

图检索增强生成(GraphRAG)已成为大模型解决复杂领域知识问答的重要解决方案之一。然而,当前学界和开源界的方案都面临着三大关键痛点: 开销巨大:通过 LLM 构建图谱及社区,Token 消耗大,耗

有意识的AI,距离我们有多近?近日,图灵奖得主Bengio等人发表在《Science》的一篇文章提到:不管是碳基,还是硅基,都可能出现意识。AI研究,可能推动越来越多的公众相信AI会产生意识,但也可能带来一系列风险与社会伦理争议。

成立107年的松下,如何赶上AI大模型的浪潮? 在日本东京接受媒体采访时,松下控股株式会社全球副总裁、集团中国东

Lovart(lovart.ai/)速度是真的快,前几天发现他们第一时间就上线了 Seedream 4.0 模型,而且在前天开启了超级优惠活动: 9.10-9.20 Nano Banana 和 Seedream 4.0 模型免费用不扣积分

刚刚,豆包·图像创作模型Seedream 4.0同时登顶「文生图」和「图像编辑」两项榜单!相比Nano Banana,Seedream 4.0在文生图的清晰度和美感上优势较为明显;在图像编辑上则难分伯仲,仅小幅领先。

啊?今天早上9点多的时候。 美团上线了他们的首个生活类Agent。 名字,叫小美。 大厂们卷疯了。 这战场,真的从WAIMAI打到了AI了我靠。 而且还真的居然被我猜中了。 我上周写过美团的开源大模型

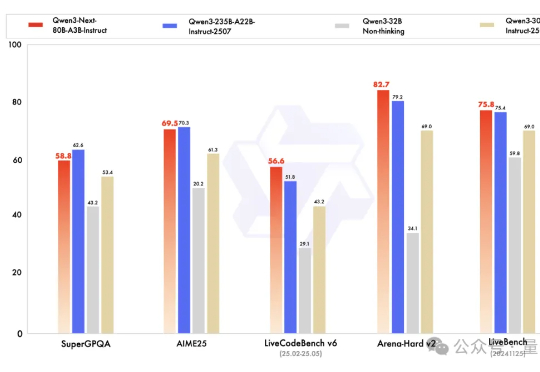

Qwen下一代模型架构,抢先来袭! Qwen3-Next发布,Qwen团队负责人林俊旸说,这就是Qwen3.5的抢先预览版。 基于Qwen3-Next,团队先开源了Qwen3-Next-80B-A3B-Base。