你以为的LLM上下文学习超能力,究竟来自哪里,ICL的内部机制如何 |最新发布

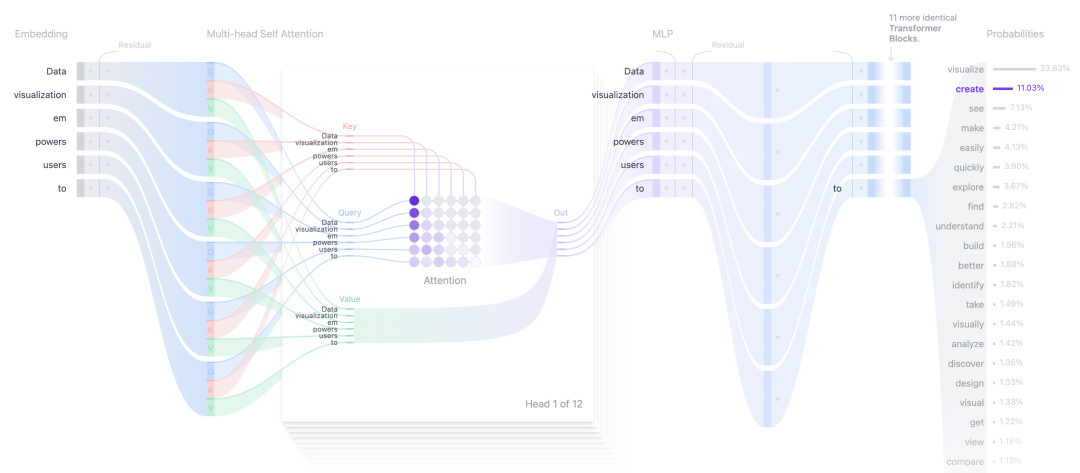

你以为的LLM上下文学习超能力,究竟来自哪里,ICL的内部机制如何 |最新发布上下文学习(In-Context Learning, ICL)是指LLMs能够仅通过提示中给出的少量样例,就迅速掌握并执行新任务的能力。这种“超能力”让LLMs表现得像是一个"万能学习者",能够在各种场景下快速适应并产生高质量输出。然而,关于ICL的内部机制,学界一直存在争议。

上下文学习(In-Context Learning, ICL)是指LLMs能够仅通过提示中给出的少量样例,就迅速掌握并执行新任务的能力。这种“超能力”让LLMs表现得像是一个"万能学习者",能够在各种场景下快速适应并产生高质量输出。然而,关于ICL的内部机制,学界一直存在争议。

在把AI大模型能力接入微信后,发现很多朋友想要落地在类似客服的应用场景。但目前大模型存在幻觉,一不留神就胡乱回答,这在严肃的商用场景下是不可接受的。

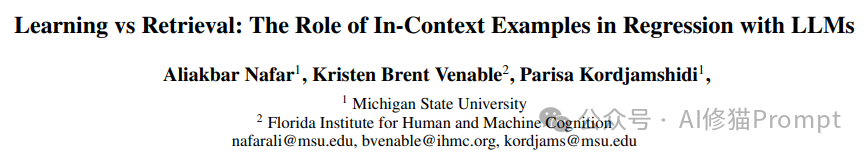

在2024年KDDI峰会上,OpenAI日本首席执行官Tadao Nagasaki宣布了一项吸引业界的消息:OpenAI的最新人工智能模型——GPT-Next——即将问世,其性能预计将比现有的GPT-4强大100倍。

要说国内科技圈最近有啥话题能热过大模型,答案或许只有一个——

现在,中国的电影导演们开始尝试使用国产视频生成大模型技术制作电影级内容。

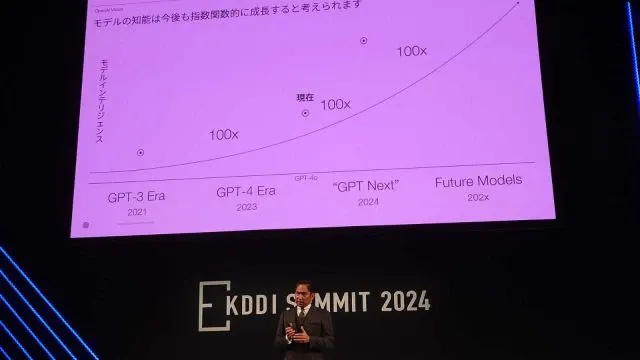

大家终于都意识到大模型首先改变的是软件行业自己,而软件的根基是代码生成。代码生成第一波就是AI辅助开发,这个会是大模型第一个杀手级应用。

高盛一张关于“ChatGPT访问量跳水”的图,一度引发大范围恐慌。但最终被证明不过是虚惊一场。

在AI-2.0时代,OCR模型的研究难道到头了吗!?

之前已经分享过一次AI领域GitHub上那些神级项目,大家可以回顾下这篇文章《震撼来袭,盘点GitHub上那些免费的神级AI项目,建议立刻收藏!》。但是AI发展那么迅速,所以今天继续来给大家盘点一下近期在Github上,AI领域又有哪些神级的项目,最后一个特别推荐。

“AI一天,人间一年”,在2024年,AI带来的高速技术迭代和海量资讯刷新还在持续。