对话 Kuse: 没融资 3 个月 1000 万美金 ARR,用 NotebookLM 的方法重做 Notion

对话 Kuse: 没融资 3 个月 1000 万美金 ARR,用 NotebookLM 的方法重做 Notion今年我比较喜欢的 AI 产品中,一个是 Google 旗下的 NotebookLM,我觉得它的价值还没有真正体现出来。还有一个是国内团队做的 Kuse,其团队在没融资的情况下,3 个月做到了差不多 1000 万美金的 ARR。

今年我比较喜欢的 AI 产品中,一个是 Google 旗下的 NotebookLM,我觉得它的价值还没有真正体现出来。还有一个是国内团队做的 Kuse,其团队在没融资的情况下,3 个月做到了差不多 1000 万美金的 ARR。

香港中文大学提出了一个全新的算法框架RankSEG,用于提升语义分割任务的性能。传统方法在预测阶段使用threshold或argmax生成掩码,但这种方法并非最优。RankSEG无需重新训练模型,仅需在推理阶段增加三行代码,即可显著提高Dice或IoU等分割指标。

Notion 创始人 Ivan Zhao 在最新的博文中提到,我们正处于 AI 的「水车阶段」,还在试图把新时代的引擎,硬塞进旧时代的马车里。 原文🔗 https://www.notion.com/b

十年前,三星工程师 June Paik 因跟腱断裂卧床,却意外在床上洞察到了 AI 浪潮。十年后,他创立的 FuriosaAI 拒绝了 Meta 的收购,带着名为「叛逆者(RNGD)」的芯片,誓要在英伟达主宰的算力帝国中撕开一道缺口。

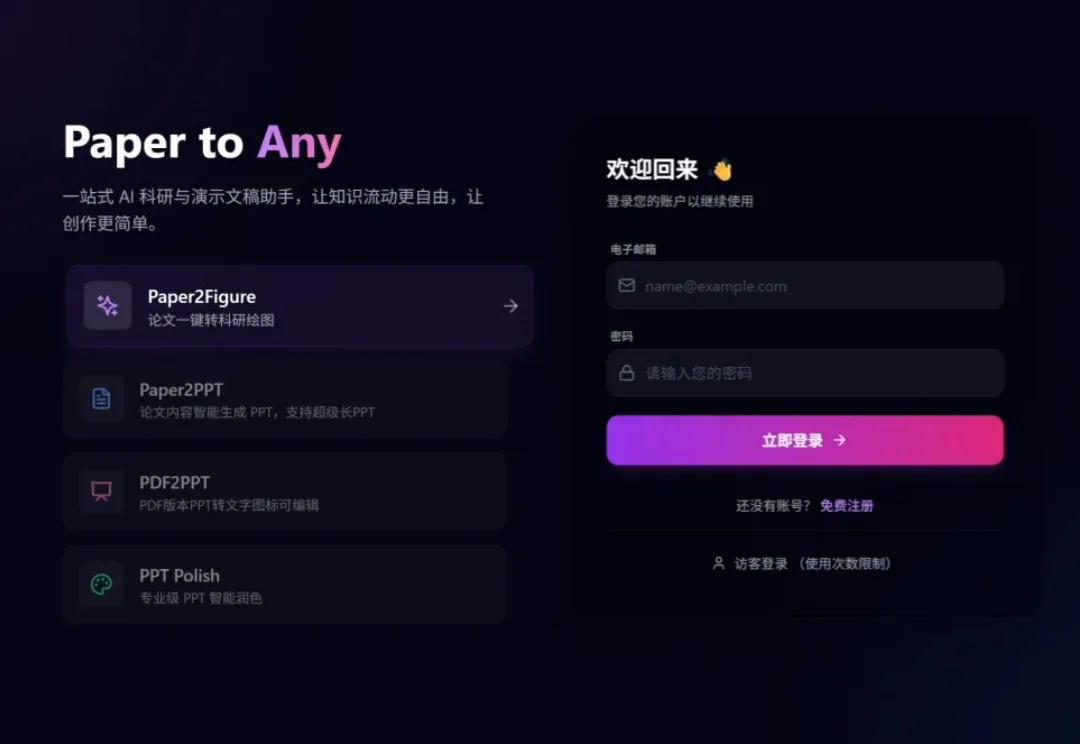

你是否经历过这样的至暗时刻: 明明实验数据已经跑通,核心逻辑也已梳理完毕,却在面对空白的 PPT 页面时陷入停滞; 明明脑海里有清晰的系统架构,却要在 Visio 或 Illustrator 里跟一根歪歪扭扭的线条较劲半小时; 好不容易用 AI 生成了一张精美的流程图,却发现上面的文字是乱码,或者为了改一个配色不得不重新生成几十次……

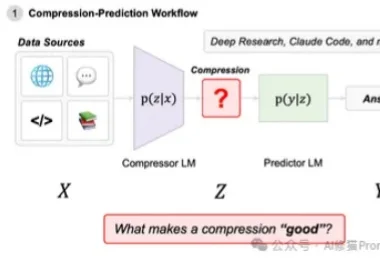

在近一年里,Agentic System(代理系统/智能体系统)正变得无处不在。从Open AI的Deep Research到Claude Code,我们看到越来越多的系统不再依赖单一模型,而是通过多模型协作来完成复杂的长窗口任务。

最近在研究 RAG 系统优化的时候,发现了一个有意思的格式叫 TOON。全称是 Token-Oriented Object Notation,翻译过来就是面向 Token 的对象表示法。

近日,腾讯微信 AI 团队提出了 WeDLM(WeChat Diffusion Language Model),这是首个在工业级推理引擎(vLLM)优化条件下,推理速度超越同等 AR 模型的扩散语言模型。

最近,APPSO 终于拿到了这台来自黄仁勋倾情推荐的个人超算,英伟达 DGX Spark;到手的第一感觉,就是「小而美」。这电脑也太小了,没有 Mac Studio 那般笨重,可能就和 Mac Mini 差不多大;然后是银色的亮和用来散热的金属丝网又让它有点不一样,是专属的硬核美感。

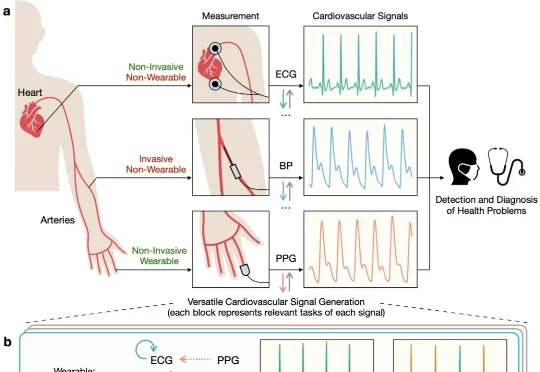

近日,清华朱军等团队提出了一种统一的多模态生成框架 UniCardio,在单扩散模型中同时实现了心血管信号的去噪、插补与跨模态生成,为真实场景下的人工智能辅助医疗提供了一种新的解决思路。