Transformer八周年!Attention Is All You Need被引破18万封神

Transformer八周年!Attention Is All You Need被引破18万封神Transformer已满8岁,革命性论文《Attention Is All You Need》被引超18万次,掀起生成式AI革命。Transformer催生了ChatGPT、Gemini、Claude等诸多前沿产品。更重要的是,它让人类真正跨入了生成式AI时代。

Transformer已满8岁,革命性论文《Attention Is All You Need》被引超18万次,掀起生成式AI革命。Transformer催生了ChatGPT、Gemini、Claude等诸多前沿产品。更重要的是,它让人类真正跨入了生成式AI时代。

今天,一个坐标北京海淀,一支年轻的创业团队,正在小范围 Alpha 测试一款叫 Teamo 的全新 Agent 产品。 给你们看下这个产品的恐怖数据——平均每 2.5 个看到这个产品的人,里面就有 1 个人想要参与 Alpha 内测...

据 The Information 报道,有消息称 Meta 将以 148 亿美元收购 Scale AI 49% 的股权,而作为交易的一部分,Scale AI CEO Alexandr Wang 将在 Meta 内部担任高级职位,领导一个新的「超级智能(Superintelligence)」实验室。

红杉专访OpenAI Codex团队揭示AI编程的未来:从工具协作迈向「异步自主Agent」时代。Codex正从代码补全演化为可独立完成任务的智能体。此外还有更大爆料!

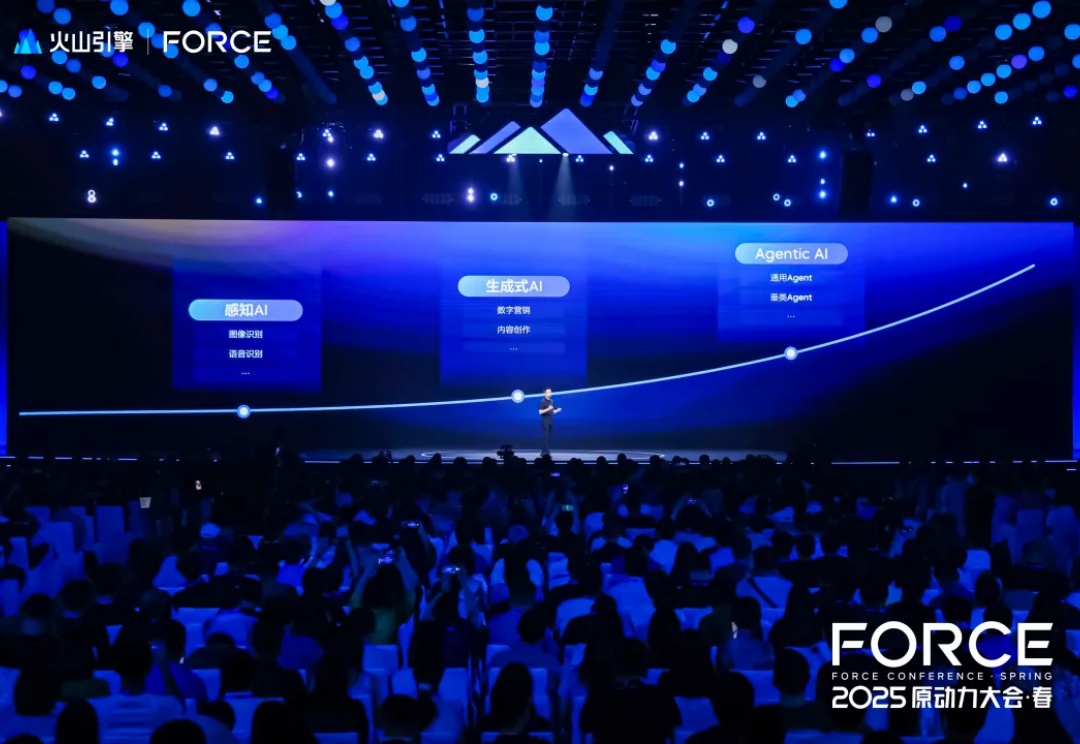

我一直认为,火山引擎是一家比较有气质的云计算企业——思维新颖,动作很快,且打法总是直来直去。

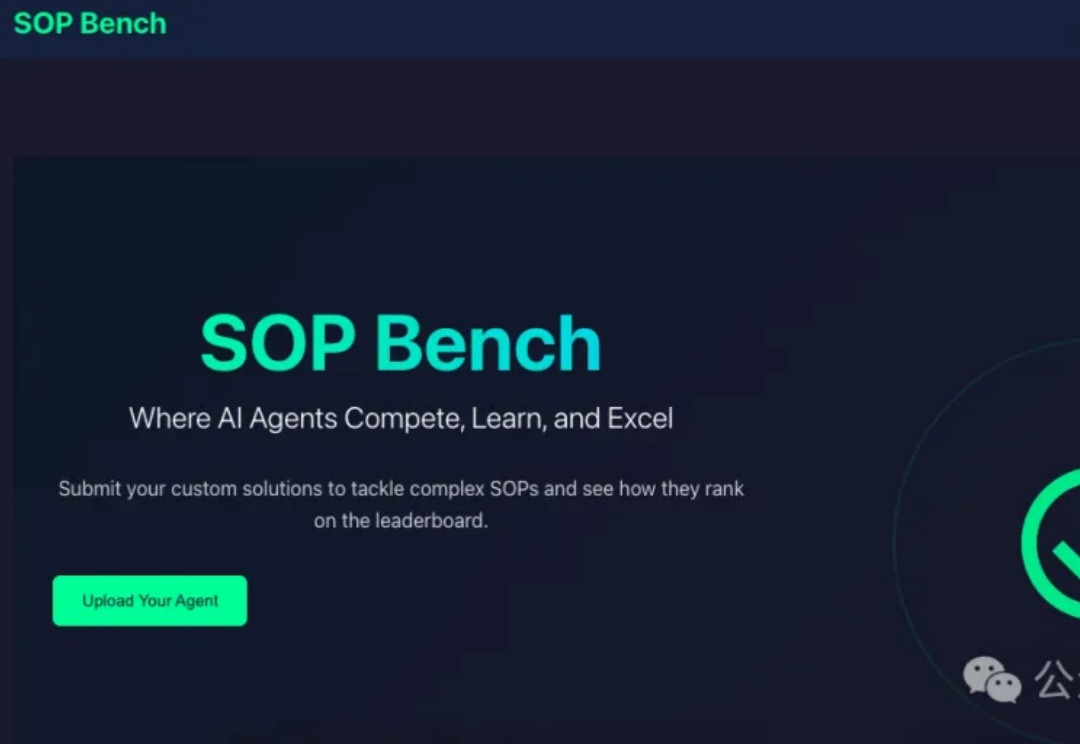

您可能会问,LLM Agent的SOP到底是什么,为什么称它为AI的高考?SOP全称是标准操作程序(Standard Operating Procedures)很多朋友可能很熟悉,但它绝不是简单的步骤清单——它更像是AI能否在工业环境中真正"上岗"的终极考验。

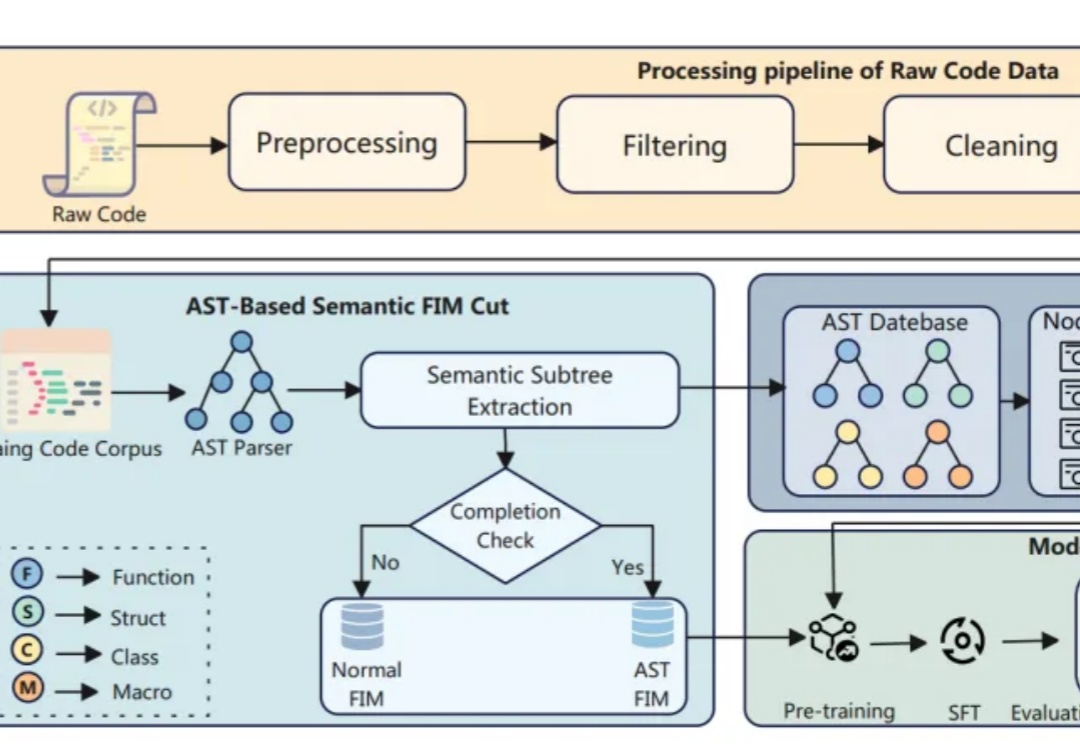

如何让AI代码补全更懂开发者?

强化学习·RL范式尝试为LLMs应用于广泛的Agentic AI甚至构建AGI打开了一扇“深度推理”的大门,而RL是否是唯一且work的一扇门,先按下不表(不作为今天跟大家唠的重点),至少目前看来,随着o1/o3/r1/qwq..等一众语言推理模型的快速发展,正推动着LLMs和Agentic AI在不同领域的价值与作用,

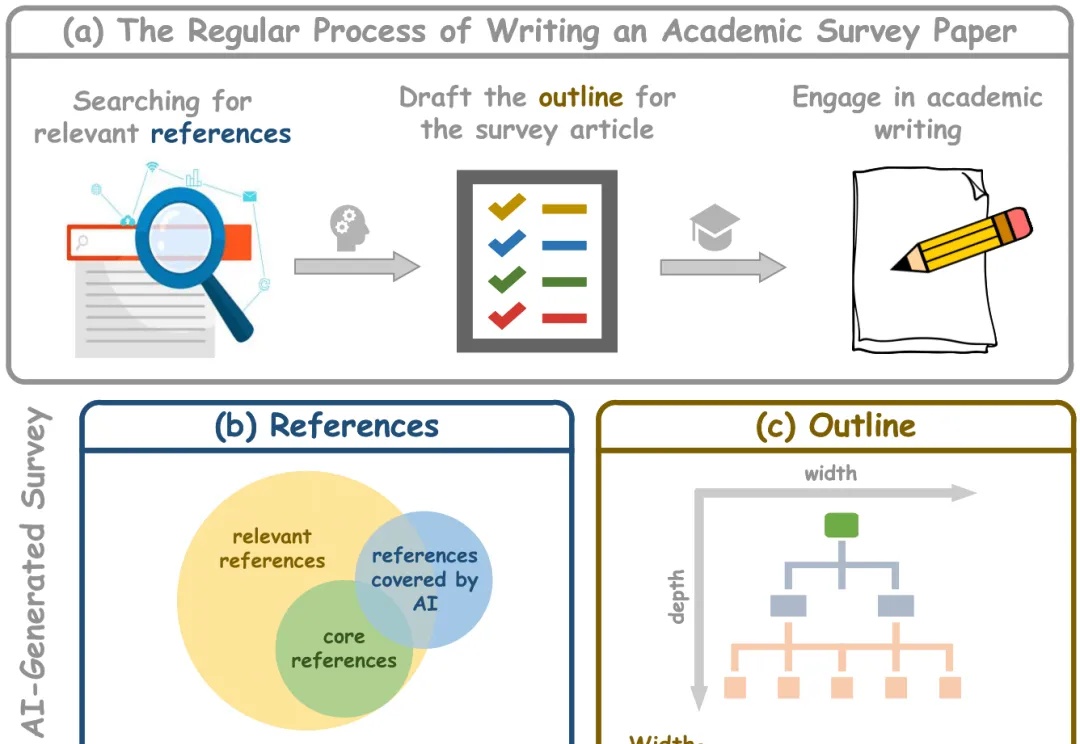

学术综述论文在科学研究中发挥着至关重要的作用,特别是在研究文献快速增长的时代。传统的人工驱动综述写作需要研究者审阅大量文章,既耗时又难以跟上最新进展。而现有的自动化综述生成方法面临诸多挑战:

AI 搜索 Agent 产品 Genspark 近期被 Anthropic 官方点名了。「Less structure, more intelligence.」是 AI 搜索 Agent 产品 Genspark 一直以来坚持的基本原则。Genspark 团队认为,过度结构化的工作流程会限制创造力和深度,赋予专业 Agent 更多自主权,自由选择并灵活运用多种工具来处理问题,反而能释放出更强的能力。