如何从零开始训练大模型(minicpm分享&讨论)

如何从零开始训练大模型(minicpm分享&讨论)根据scaling law,模型越大,高质量数据越多,效果越好。 但还有一个很直观的情况,随着预训练样本的质量不断提升,训练手段的优化。新的模型,往往效果能轻松反超参数量两倍于它的模型。

根据scaling law,模型越大,高质量数据越多,效果越好。 但还有一个很直观的情况,随着预训练样本的质量不断提升,训练手段的优化。新的模型,往往效果能轻松反超参数量两倍于它的模型。

【新智元导读】性能就是模型的一切!Altman首次公开曝料:GPT-5将会有史诗级提升,小看它的公司都会被碾压。而未来,AI将成为推动文明发展的核心动力。

不久前 OpenAI Sora 以其惊人的视频生成效果迅速走红,在一众文生视频模型中突出重围,成为全球瞩目的焦点。继 2 周前推出成本直降 46% 的 Sora 训练推理复现流程后,Colossal-AI 团队全面开源全球首个类 Sora 架构视频生成模型 「Open-Sora 1.0」,涵盖了整个训练流程,包括数据处理、所有训练细节和模型权重,携手全球 AI 热爱者共同推进视频创作的新纪元。

为了Musk的开源承诺,熬了个夜,结果是果然没让人失望。 我是喜爱Musk大于Altman的(比如咱们的logo等设计,均是跟Grok一样黑白风格),喜欢他的幽默,喜欢他的真性情,喜欢他的性狡黠而守义,尽管Grok并没有那么易用

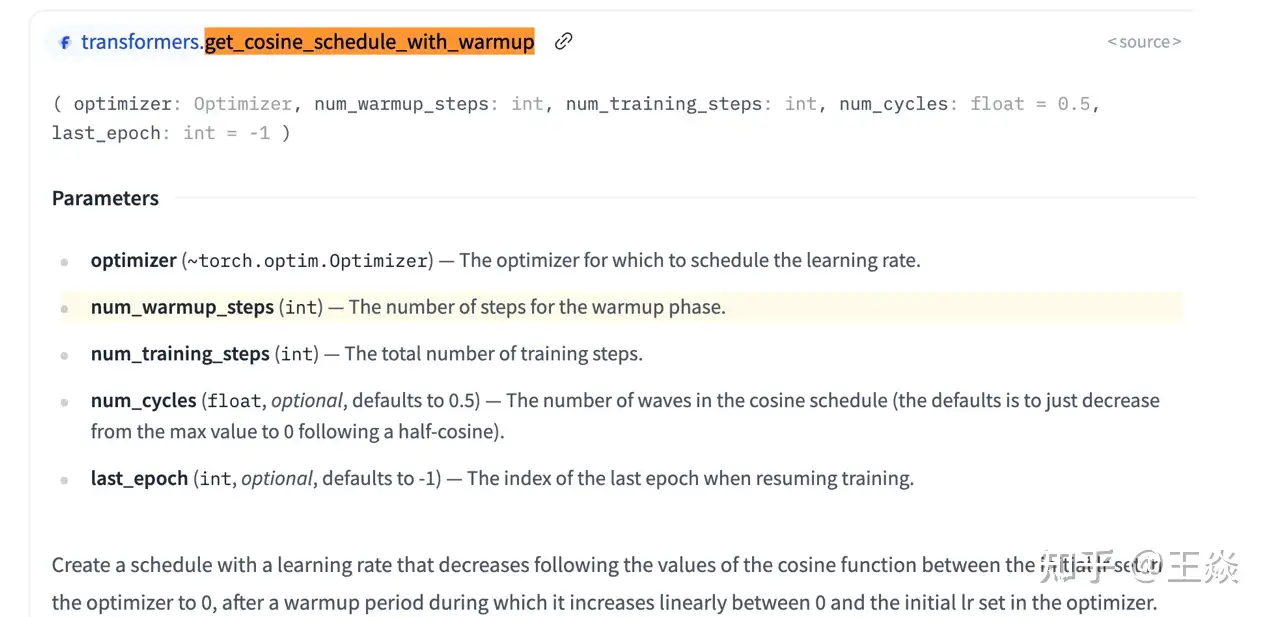

MIT新晋副教授何恺明,新作新鲜出炉:瞄准一个横亘在AI发展之路上十年之久的问题:数据集偏差。数据集偏差之战,在2011年由知名学者Antonio Torralba和Alyosha Efros提出——

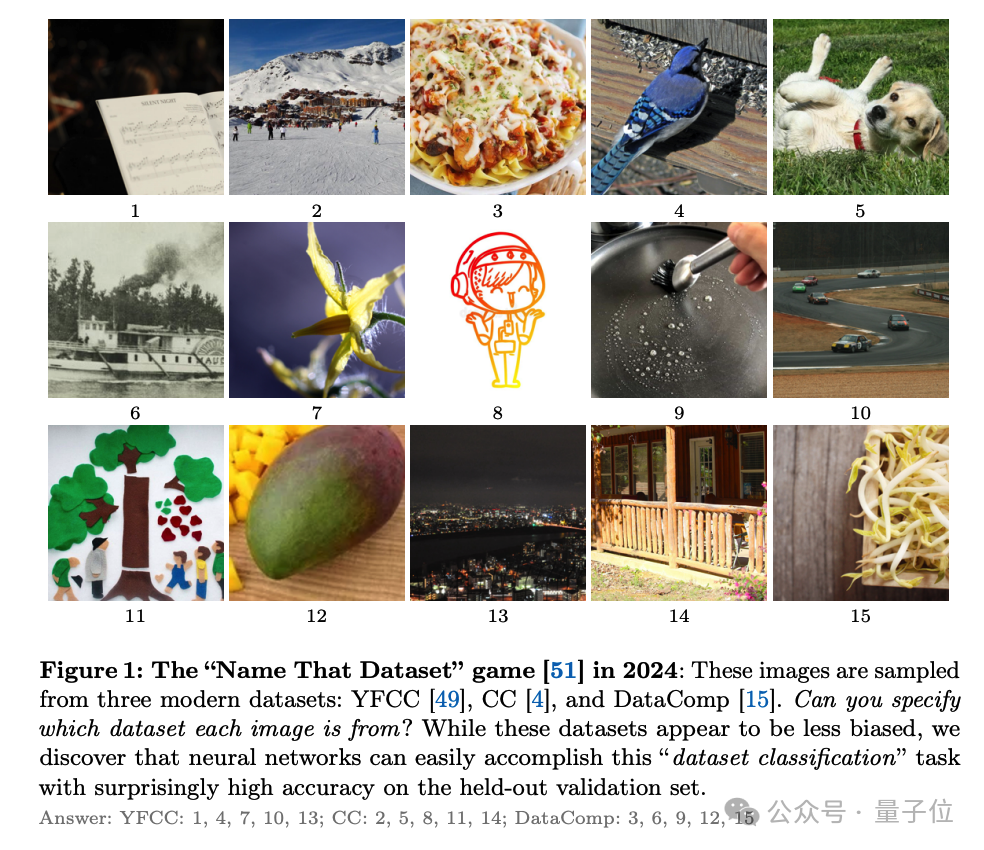

近日,谷歌DeepMind宣布推出一个可扩展指令多世界智能体(Scalable Instructable Multiworld Agent,SIMA)。

约一年前,OpenAI发布了强大的基础模型GPT-4,这催生了一批基于GPT-4打造应用的创业公司,其中就有法律AI领域的领头羊Harvey。

当地时间3月13日周三,OpenAI首席技术官米拉·穆拉蒂(Mira Murati)接受了《华盛顿邮报》的视频专访。

今天,芯片初创公司Cerebras Systems推出了全新的Wafer Scale Engine 3,并将其现有的最快 AI 芯片世界纪录加倍。

ChatGPT横空出世的2023年,欧洲能喊得上名号的全球性AI峰会有近20个,大约是美国的3倍、中国的5倍[1]。在人工智能权威杂志(AI Magazine)年末总结的“2023 Top10 AI Events”中,欧洲承办的会议占比高达70%[2]。