ICML 2026|告别「单线程」思维,智能体进化出了原生的并行推理大脑

ICML 2026|告别「单线程」思维,智能体进化出了原生的并行推理大脑近年来,大语言模型在「写得长、写得顺」这件事上进步飞快。但当任务升级到真正复杂的推理场景 —— 需要兵分多路探索、需要自我反思与相互印证、需要在多条线索之间做汇总与取舍时,传统的链式思维(Chain-of-Thought)往往就开始「吃力」:容易被早期判断带偏、发散不足、自我纠错弱,而且顺序生成的效率天然受限。

搜索

搜索

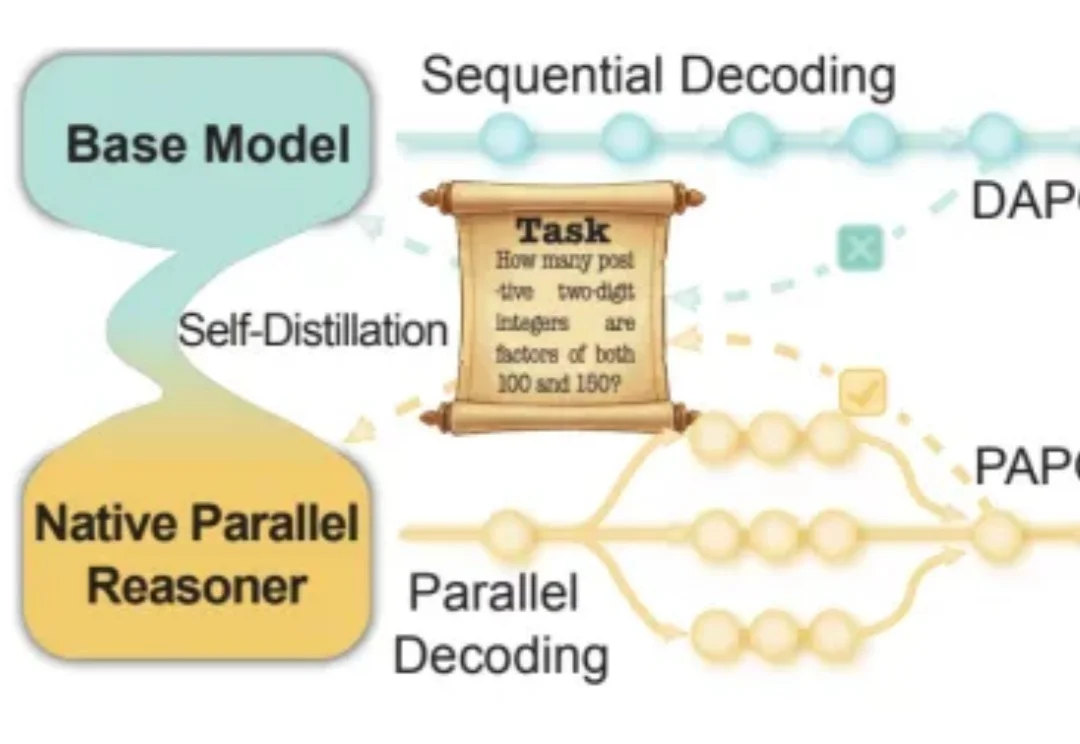

近年来,大语言模型在「写得长、写得顺」这件事上进步飞快。但当任务升级到真正复杂的推理场景 —— 需要兵分多路探索、需要自我反思与相互印证、需要在多条线索之间做汇总与取舍时,传统的链式思维(Chain-of-Thought)往往就开始「吃力」:容易被早期判断带偏、发散不足、自我纠错弱,而且顺序生成的效率天然受限。

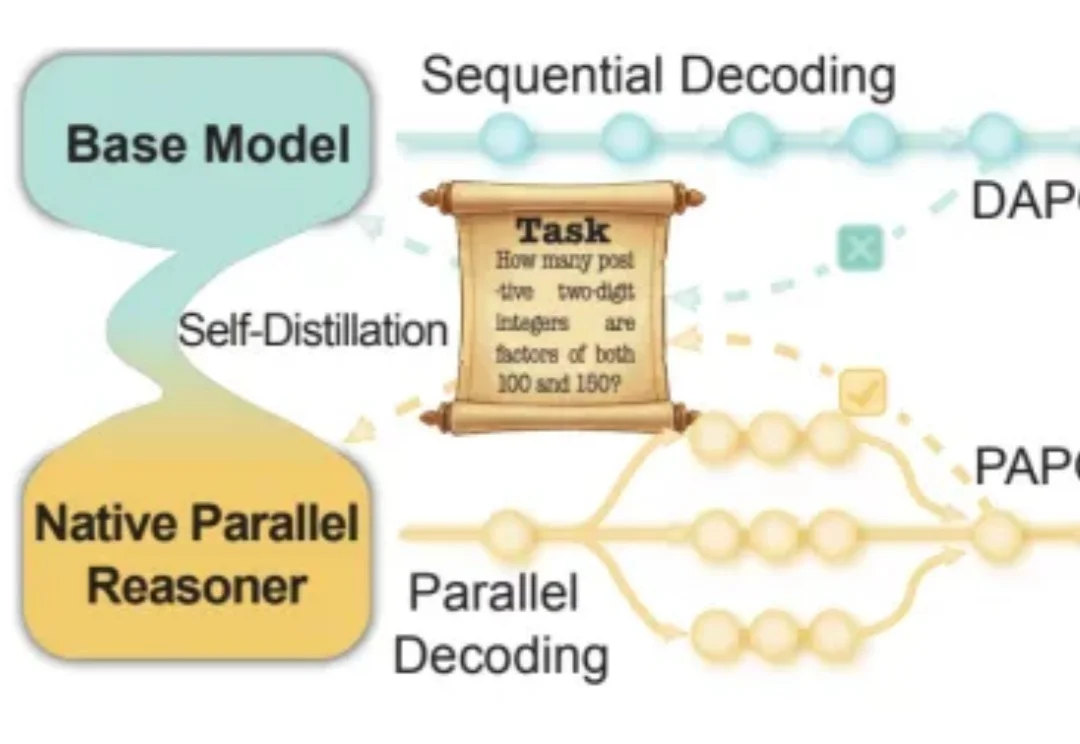

序列建模是大语言模型、计算机视觉等领域的基础共性问题。当前通用的 Transformer 模型计算复杂度随序列长度平方增长,在长序列任务中面临显著的计算挑战。因此,研究者们一直在探索具有线性计算复杂度的高效序列建模方法。

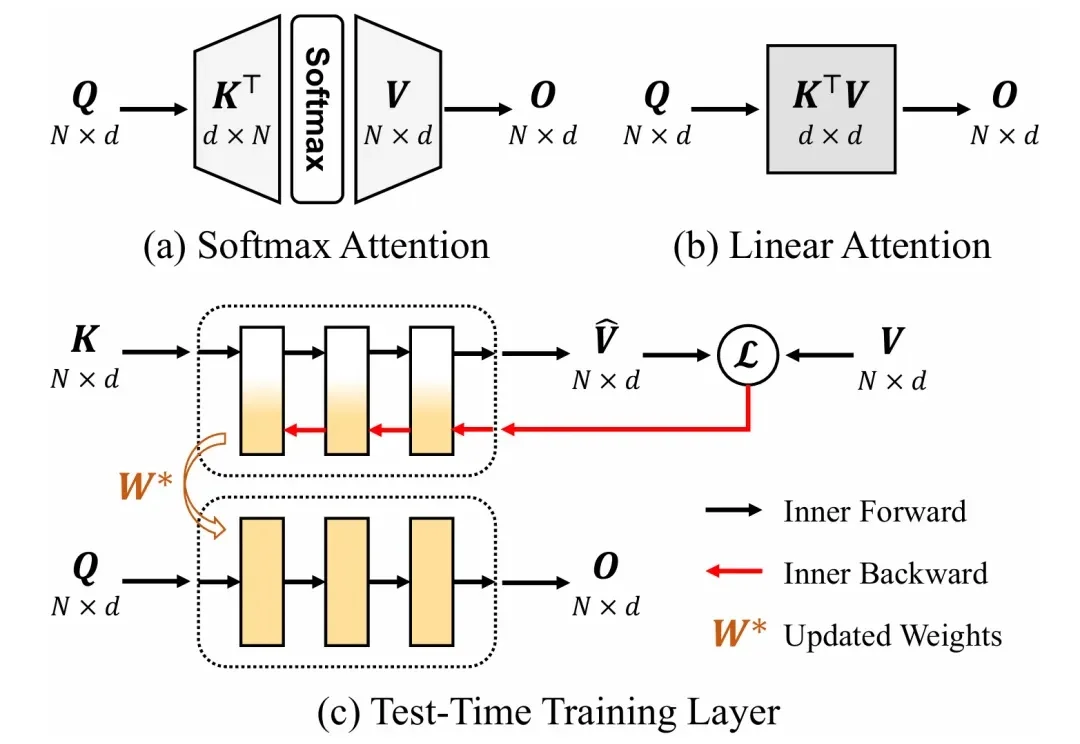

当我们在维基百科搜索一个词条时,你期待的是真相,至少在AI时代,总得有一个地方能(大概率)给我点真东西吧。可以,但在 Halupedia 搜索一个词条时,得到的也是真相——一个三秒钟前刚被发明出来的真相。

消费级机器人行业,可能要出现一次真正意义上的代际切换了。

AI Coding的玩法,又变了。

在达沃斯世界经济论坛上,《华尔街日报》总编辑 Emma Tucker 在 Journal House 跟 Anthropic CEO 阿莫迪聊了半个多小时

Reddit 上的 r/DHExchange 板块从来都不缺奇怪的交易。但月初的一个帖子,还是让见多识广的我打了个问号。「我囤积了一个非常有价值的大型数据库,只是不是你想的那种……15 万张粪便图像。」

走进智象未来合肥的办公室,首先映入眼帘的是一面员工照片墙。所有头像,都是AIGC生成的动漫风格。这家公司的核心业务是图像和视频生成——AI时代的自己,是他们在智象未来的第一课。

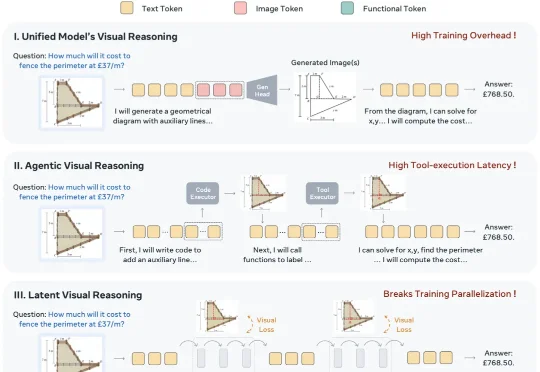

近日,Meta AI 与香港中文大学颠覆性提出了一种全新的视觉推理范式 ATLAS,不用外部工具,不显式生成中间图像,没有视觉监督信号,只用一个离散 word,首次颠覆性地代替 Agentic 和 Latent Visual Reasoning。

马耳他政府刚刚消息:向全体国民提供免费的 AI 课程,以及免费的 ChatGPT Plus 会员。马耳他成为首个把 AI 作为全民基础服务来发放的国家。项目名叫 AI for All(马耳他语 AI għal Kulħadd),意思是“全民 AI”。第一阶段五月启动,由马耳他数字创新管理局负责分发