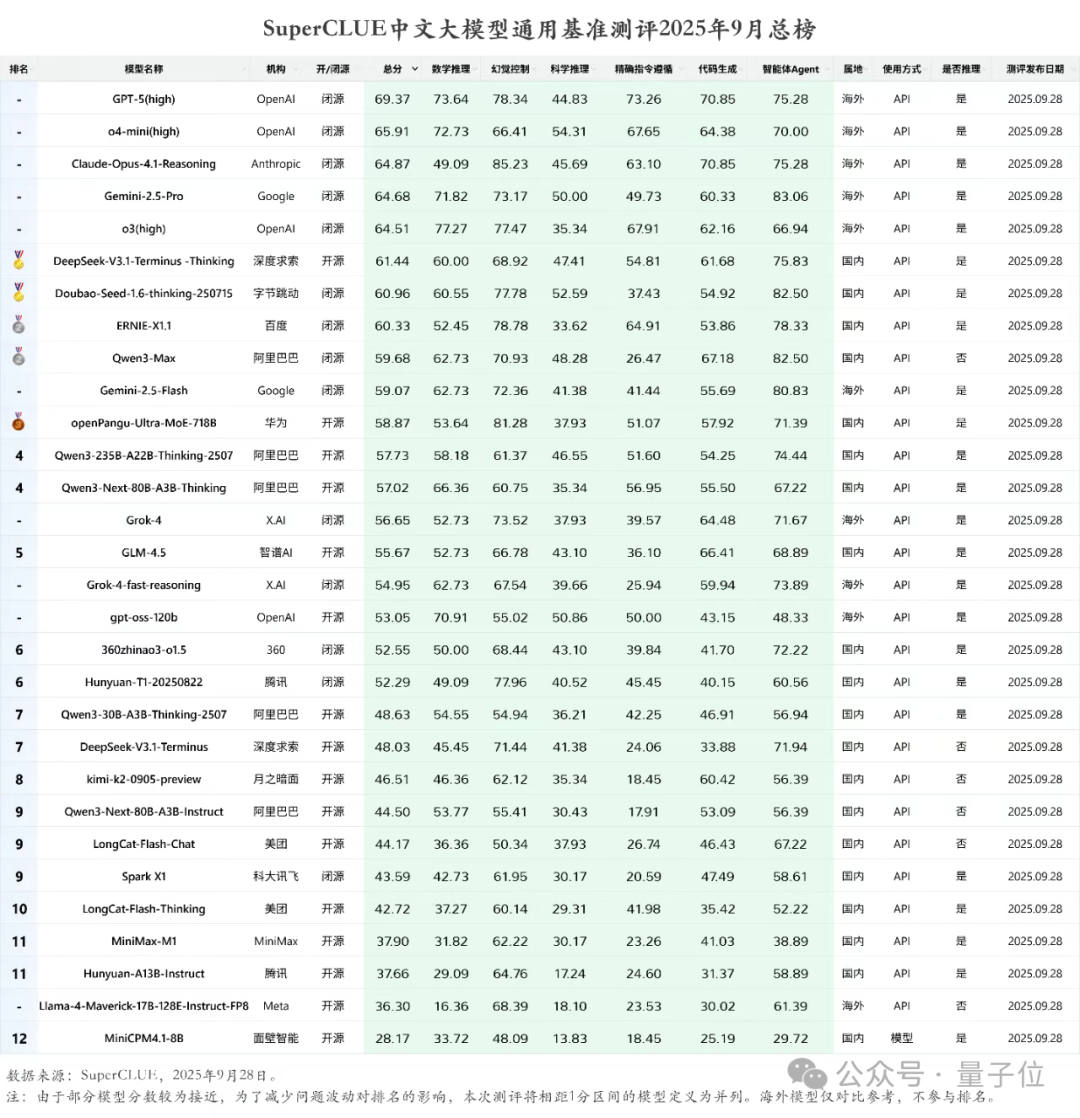

华为盘古718B模型最新成绩:开源第二

华为盘古718B模型最新成绩:开源第二就在最新一期的SuperCLUE中文大模型通用基准测评中,各个AI大模型玩家的成绩新鲜出炉。DeepSeek-V3.1-Terminus-Thinking openPangu-Ultra-MoE-718B Qwen3-235B-A22B-Thinking-2507

就在最新一期的SuperCLUE中文大模型通用基准测评中,各个AI大模型玩家的成绩新鲜出炉。DeepSeek-V3.1-Terminus-Thinking openPangu-Ultra-MoE-718B Qwen3-235B-A22B-Thinking-2507

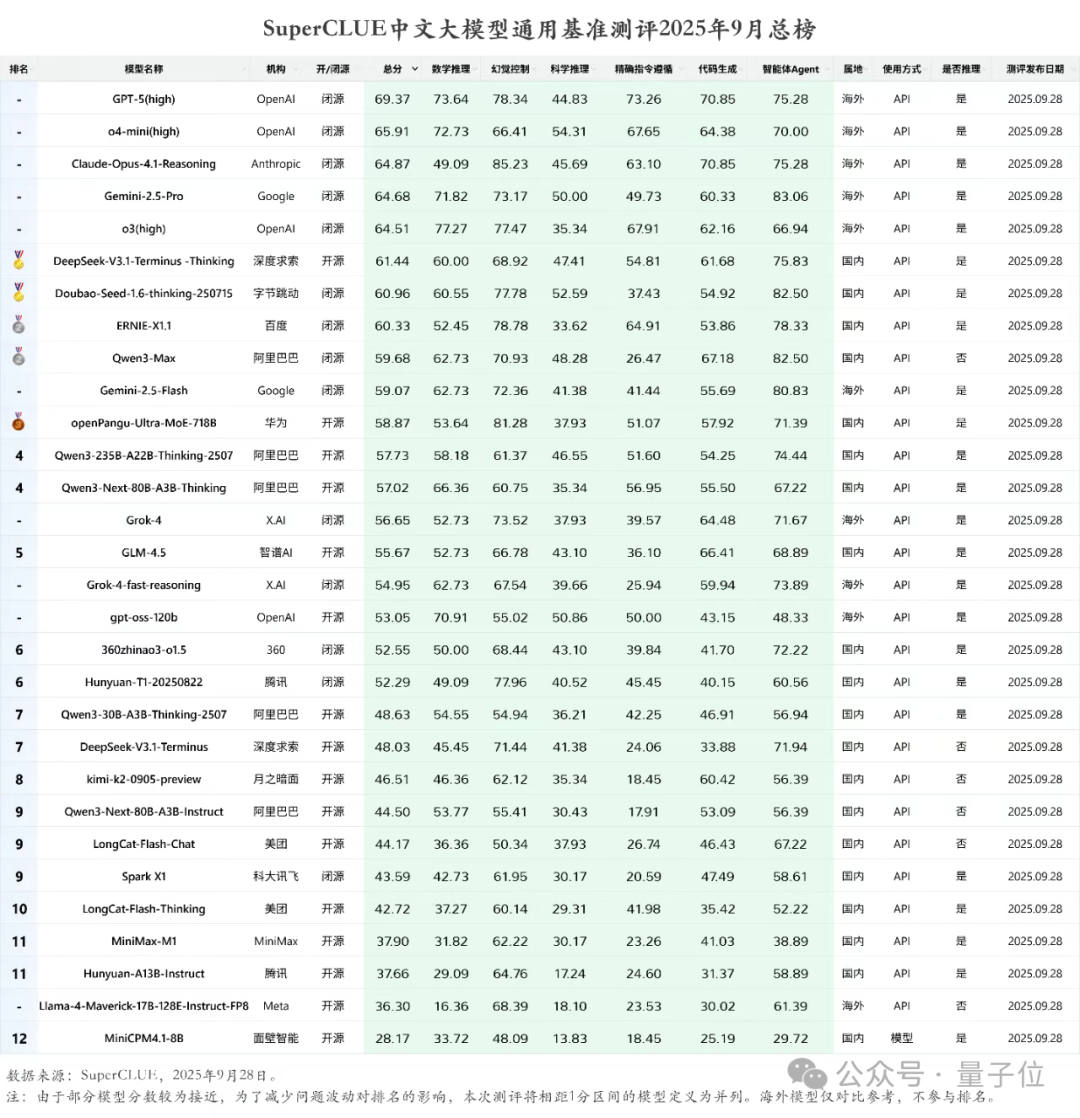

今年 8 月,GPT-5 发布,其在多个任务和基准上都表现卓越,但几乎和人世间的所有事物一样,并不是所有人都满意。尤其是 GPT-5 发布后「OpenAI 移除 ChatGPT 中模型选择器」的做法更是备受诟病(尤其是移除了情感表达更佳的 GPT-4o),甚至引发了诸多用户的「网上请愿」,详见我们的报道《用户痛批 GPT-5,哭诉「还我 GPT-4o」,奥特曼妥协了》。

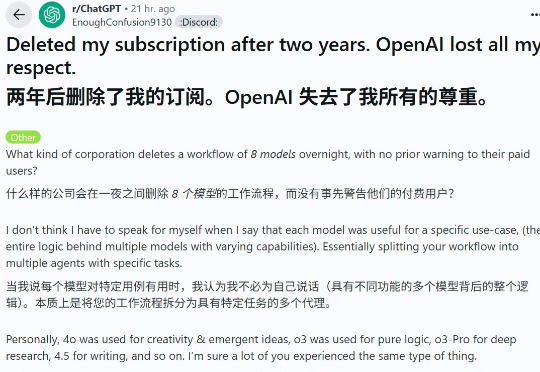

百度杀入 AI 视频生成赛道后,就一直加班加点卷个不停。 7 月初,百度第一次正式官宣蒸汽机 1.0 模型,以极致指令遵循能力惊艳亮相;8 月底,百度又发布全球首个中文音视频一体化模型百度蒸汽机 2.0,实现生成视频中人物口型、表情、动作的毫秒级同步。

当所有人还在为参数内卷时,智能体真正的决胜点已经转向了速度与成本。浪潮信息用两款AI服务器直接给出了答案:一个将token生成速度干到10毫秒以内,一个把每百万token成本打到1元时代。

结合RLHF+RLVR,8B小模型就能超越GPT-4o、媲美Claude-3.7-Sonnet。陈丹琦新作来了。他们提出了一个结合RLHF和RLVR优点的方法,RLMT(Reinforcement Learning with Model-rewarded Thinking,基于模型奖励思维的强化学习)。

老天奶,奥特曼对GPT的谈论,都跨越好几代来到GPT-8了!最近他在一档节目上,和量子计算奠基人戴维・多伊奇(David Deutsch)展开对话,针对两人存在分歧的“AI能否发展为具备意识的超级智能”议题,奥特曼搬出GPT-8来试图说服多伊奇:

明星创业公司Thinking Machines,第二篇研究论文热乎出炉!公司创始人、OpenAI前CTO Mira Murati依旧亲自站台,翁荔等一众大佬也纷纷转发支持:论文主题为“Modular Manifolds”,通过让整个网络的不同层/模块在统一框架下进行约束和优化,来提升训练的稳定性和效率。

最近,一家叫 Numeral 的公司刚刚完成了 3500 万美元的 B 轮融资,由 Mayfield 领投,Benchmark、Uncork Capital、Y Combinator 和 Mantis 参与。这轮融资距离他们今年 3 月完成的 1800 万美元 A 轮仅仅过去了 6 个月,公司估值已经达到 3.5 亿美元。

在大模型训练时,如何管理权重、避免数值爆炸与丢失?Thinking Machines Lab 的新研究「模块流形」提出了一种新范式,它将传统「救火式」的数值修正,转变为「预防式」的约束优化,为更好地训练大模型提供了全新思路。

开源框架实现100%可复现的稳定RL训练!下图是基于Qwen3-8B进行的重复实验。两次运行,一条曲线,实现了结果的完美重合,为需要高精度复现的实验场景提供了可靠保障。这就是SGLang团队联合slime团队的最新开源成果。