GPU泡沫破灭前夜:2美元/小时出租,H100算力价格暴跌75%

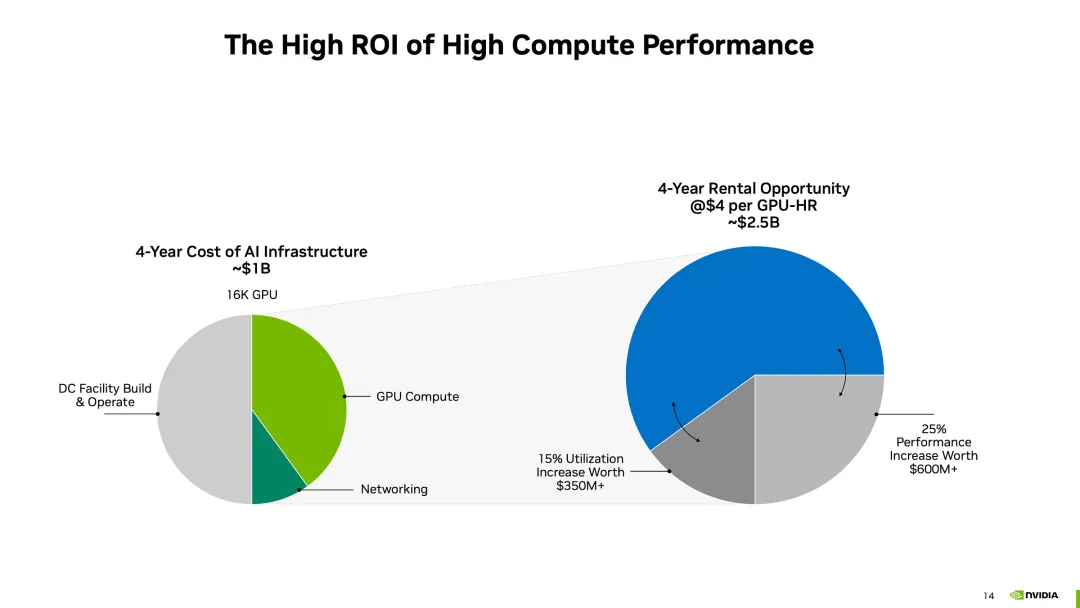

GPU泡沫破灭前夜:2美元/小时出租,H100算力价格暴跌75%红杉资本的报告曾指出,AI产业的年产值超过6000亿美元,才够支付数据中心、加速GPU卡等AI基础设施费用。而现在一种普遍说法认为,基础模型训练的资本支出是“历史上贬值最快的资产”,但关于GPU基础设施支出的判定仍未出炉,GPU土豪战争仍在进行。

红杉资本的报告曾指出,AI产业的年产值超过6000亿美元,才够支付数据中心、加速GPU卡等AI基础设施费用。而现在一种普遍说法认为,基础模型训练的资本支出是“历史上贬值最快的资产”,但关于GPU基础设施支出的判定仍未出炉,GPU土豪战争仍在进行。

10月3日,OpenAI官方宣布成功获得66亿美元(约合人民币466.9亿元)融资。本轮融资结束后,OpenAI估值突破了1500亿美元。新一轮融资规模不小,然而却只够Open“烧”一年,其预计,今年营收可达37亿美元,亏损幅度为50亿美元。

一台4090笔记本,秒生1K质量高清图。英伟达联合MIT清华团队提出的Sana架构,得益于核心架构创新,具备了惊人的图像生成速度,而且最高能实现4k分辨率。

英伟达开源了超强模型Nemotron-70B,后者一经发布就超越了GPT-4o和Claude 3.5 Sonnet,仅次于OpenAI o1!AI社区惊呼:新的开源王者又来了?业内直呼:用Llama 3.1训出小模型吊打GPT-4o,简直是神来之笔!

AI人才大震荡!17位高管“解雇”CEO,一场轰动科技圈的换将门

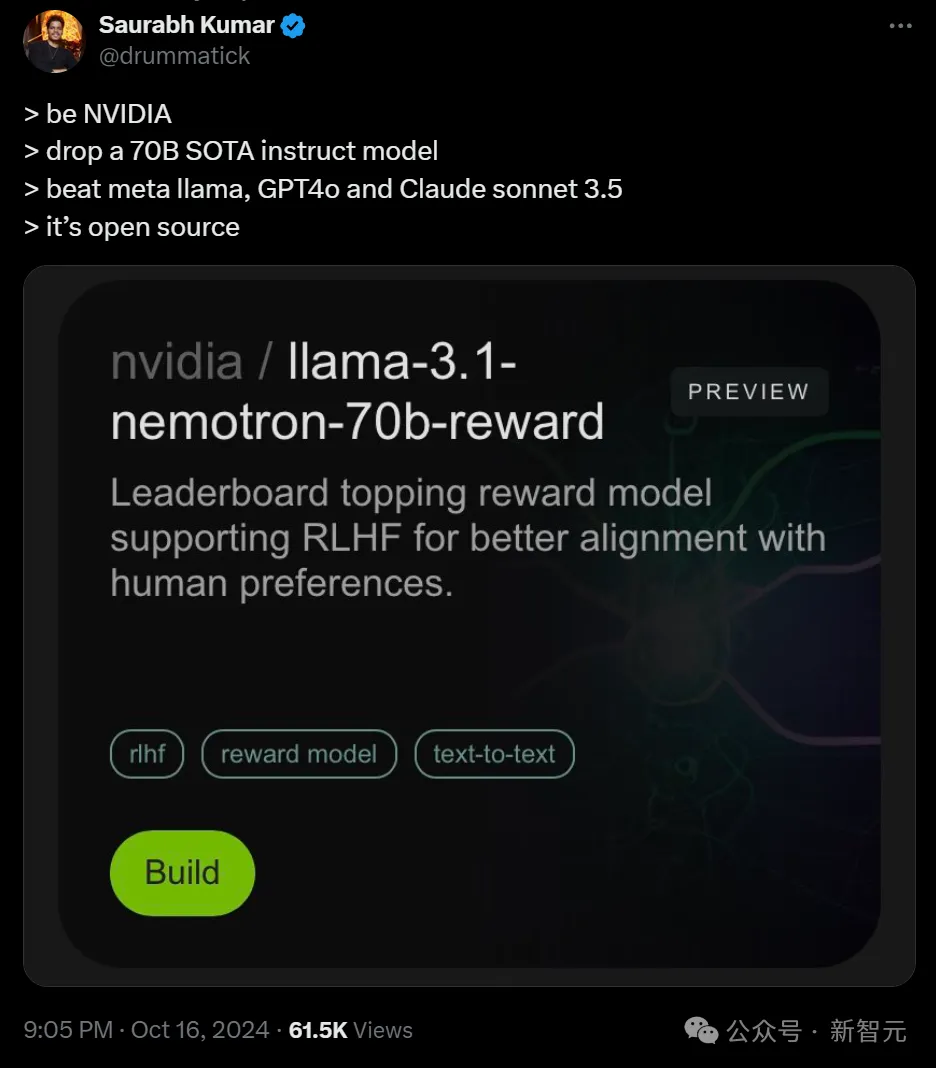

中国独角兽公司的平均估值约为 27.83 亿美元,而美国独角兽公司的平均估值约为 52.16 亿美元。美国是中国的接近2倍。

世界上充满了病毒。这些传染性生物体被广泛认为是地球上最丰富的生物实体。但我们对病毒及其在我们世界中所扮演角色的全面理解受到了我们对其惊人多样性知识匮乏的限制。

AI已完全融入数学家的工作流中。陶哲轩刚刚宣布,最新方程理论项目已完成99.9963%,众包之力外加AI辅助取得了重大成绩。他认为,剩余大约700个让人类头疼的难题,AI或许更有潜力。

自近日获知自己摘得诺贝尔物理学奖之后,76 岁的人工智能教父 Geoffrey Hinton 便「闲不住」了。

1%的合成数据,就让LLM完全崩溃了? 7月,登上Nature封面一篇论文证实,用合成数据训练模型就相当于「近亲繁殖」,9次迭代后就会让模型原地崩溃。