400万token新SOTA!英伟达UIUC联手:兼顾长短上下文顶尖性能

400万token新SOTA!英伟达UIUC联手:兼顾长短上下文顶尖性能来自英伟达和UIUC的华人团队提出一种高效训练方法,将LLM上下文长度从128K扩展至惊人的400万token SOTA纪录!基于Llama3.1-Instruct打造的UltraLong-8B模型,不仅在长上下文基准测试中表现卓越,还在标准任务中保持顶尖竞争力。

搜索

搜索

来自英伟达和UIUC的华人团队提出一种高效训练方法,将LLM上下文长度从128K扩展至惊人的400万token SOTA纪录!基于Llama3.1-Instruct打造的UltraLong-8B模型,不仅在长上下文基准测试中表现卓越,还在标准任务中保持顶尖竞争力。

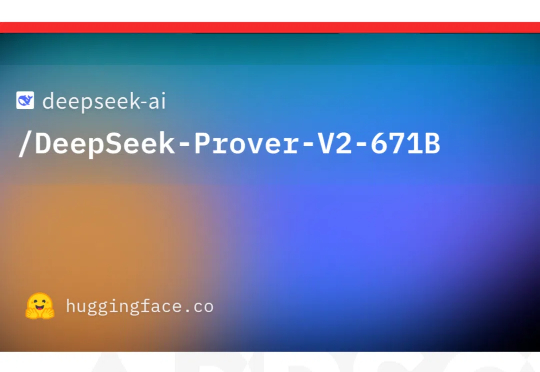

就在刚刚,DeepSeek-Prover-V2技术报告也来了!34页论文揭秘了模型的训练核心——递归+强化学习,让数学推理大提升。有人盛赞:DeepSeek已找到通往AGI的正确路径!

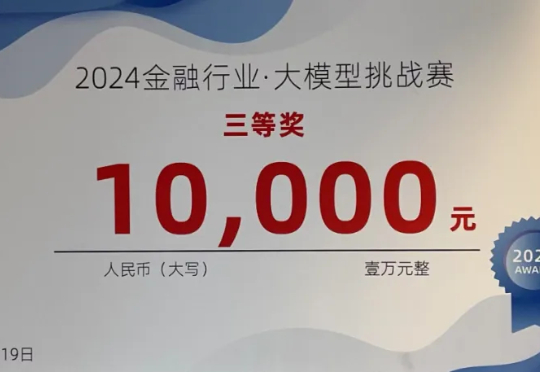

由智谱和清华大学联合举办的“地狱级”黑客松 -《2024金融行业·大模型挑战赛》。该黑客松颇为艰困,完全复刻了金融行业二级市场的真实需求。而经过数月奋战,我,作为一名金融市场“门外汉”,在1300+名选手中“杀出一条血路”,最终获得了全国第七名以及10,000元的奖金。

近日,以色列宣布与以色列AI“数字化身”制作平台eSelf、以色列最大的K12教科书出版商CET(Center for Educational Technology)合作,在全国范围内铺开AI辅导。

北京时间4月29日,据《华尔街日报》报道,OpenAI CEO萨姆·奥特曼(Sam Altman)曾表示,OpenAI与微软拥有堪称“科技界最好的合作关系”。然而,这段硅谷“联姻”已经岌岌可危。

就在刚刚,DeepSeek 在全球最大 AI 开源社区 Hugging Face 发布了一个名为 DeepSeek-Prover-V2-671B 的新模型。

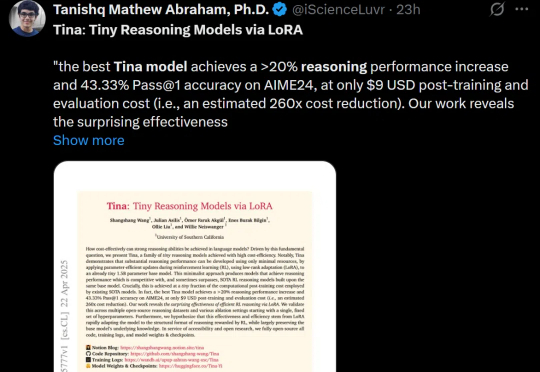

在人工智能领域,语言模型的发展日新月异,推理能力作为语言模型的核心竞争力之一,一直是研究的焦点,许多的 AI 前沿人才对 AI 推理的效率进行研究。

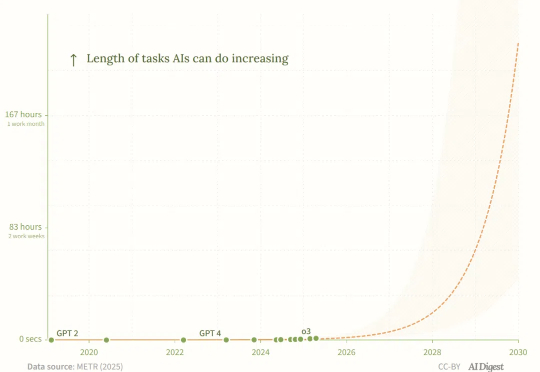

AI编程智能体的能力正在飞速增长,最新研究揭示了这一「新摩尔定律」,如果AI智能体的任务时长继续以每4个月翻倍的速度增长,到2027年它们可能完成长达167小时的月级任务!

今天上午,小米发布了其首个开源推理大模型-Xiaomi MiMo。通过 25 T 预训练 + MTP 加速 + 规则化 RL + Seamless Rollout,让 7 B 参数的 MiMo-7B 在数理推理和代码生成上赶超 30 B-32 B 大模型,并完整 MIT 开源全系列与工程链,给端-云一体 AI 落地提供了“以小博大”的新范例。

4月29日圣何塞现场报道,今日,在2025英特尔代工大会(Intel Foundry Direct Connect)上,英特尔CEO陈立武携多位英特尔代工高管分享了多代核心制程和先进封装的技术进展、生态合作及未来战略,展露面向AI时代提供系统级代工的雄心。芯东西从大会前排发来一手报道。