让龙虾看懂屏幕!谷歌多模态新成果,文本图像视频音频进同一空间

让龙虾看懂屏幕!谷歌多模态新成果,文本图像视频音频进同一空间刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——Gemini Embedding 2。这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——Gemini Embedding 2。这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

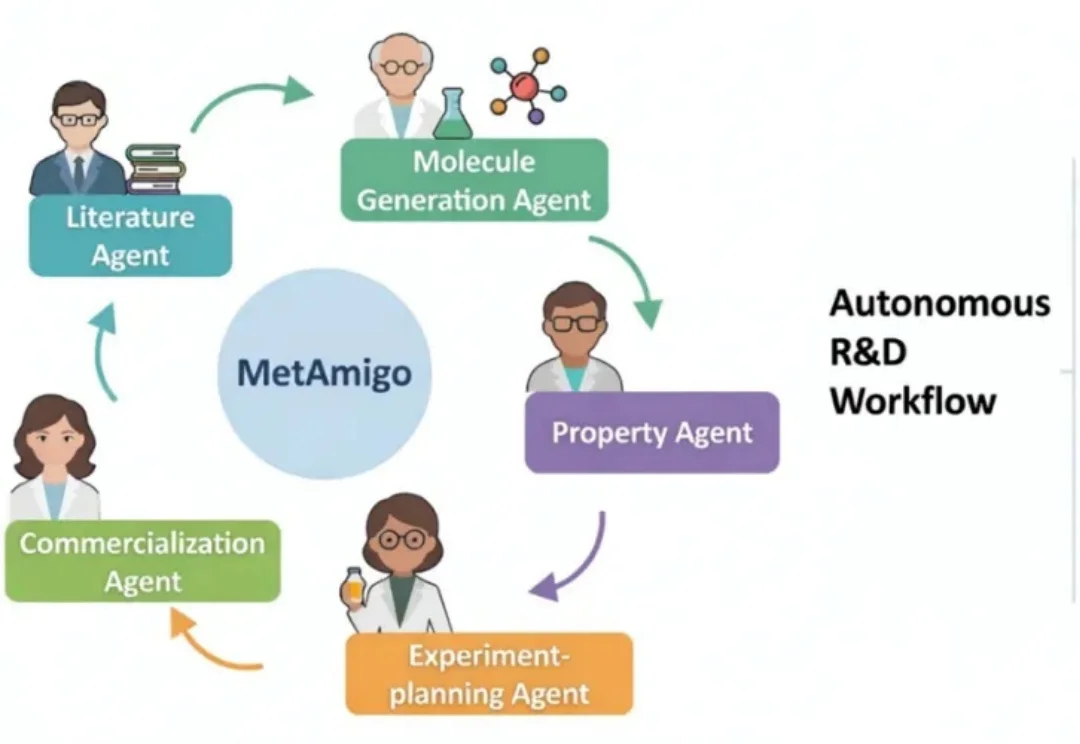

2026 年伊始,AI 的进化逻辑正从「单一工具赋能」转向「场景深度共生」,当大模型在各领域持续突破,前沿科研与新材料研发领域,正迎来一场由 Agentic AI 驱动的效率革命。

进入到 2026 年,人工智能领域被一只「龙虾」(OpenClaw)硬控了。这种具备高主动性、强活人感的私人 AI 助理成为了新一代人机交互的标杆。

ber,装龙虾这才几天啊,怎么就直接二倍速到卸载了???

杭州萧山设立5000万元开源智能体专项基金。

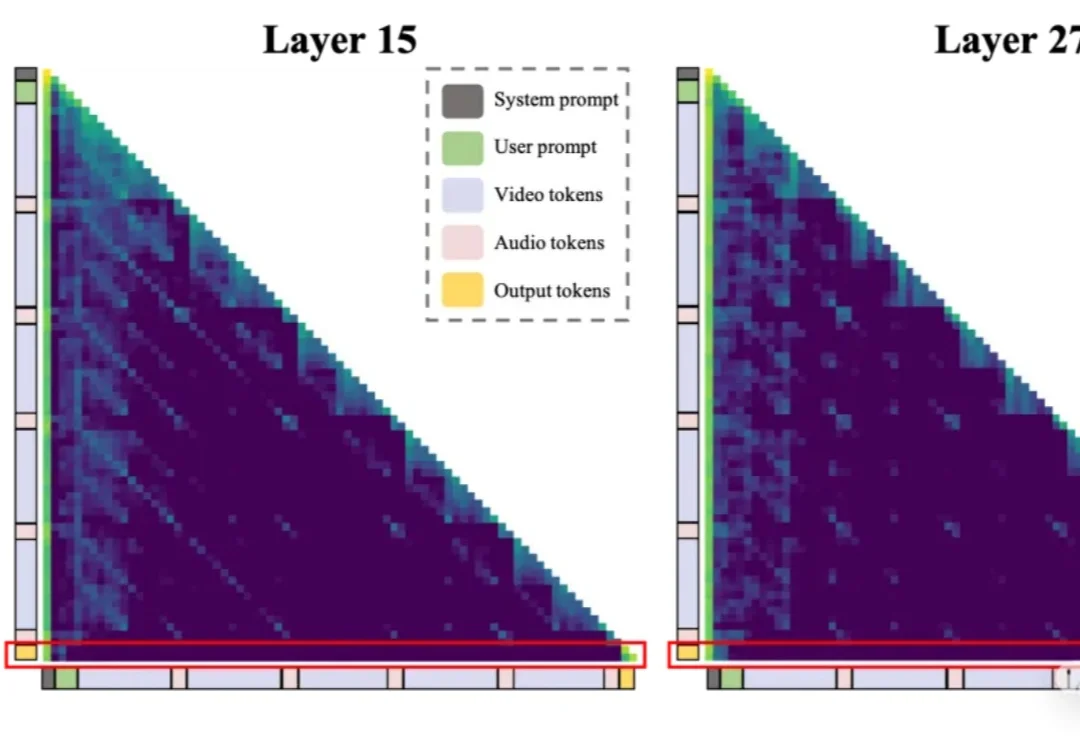

一段几十秒的音视频,上万Token,一半以上是冗余——Omni-LLM的计算浪费,比想象中更严重。

具身智能的胜负手,可能并不在机器人本身。

让AI像Kaggle顶尖选手一样设计算法,需要几步?

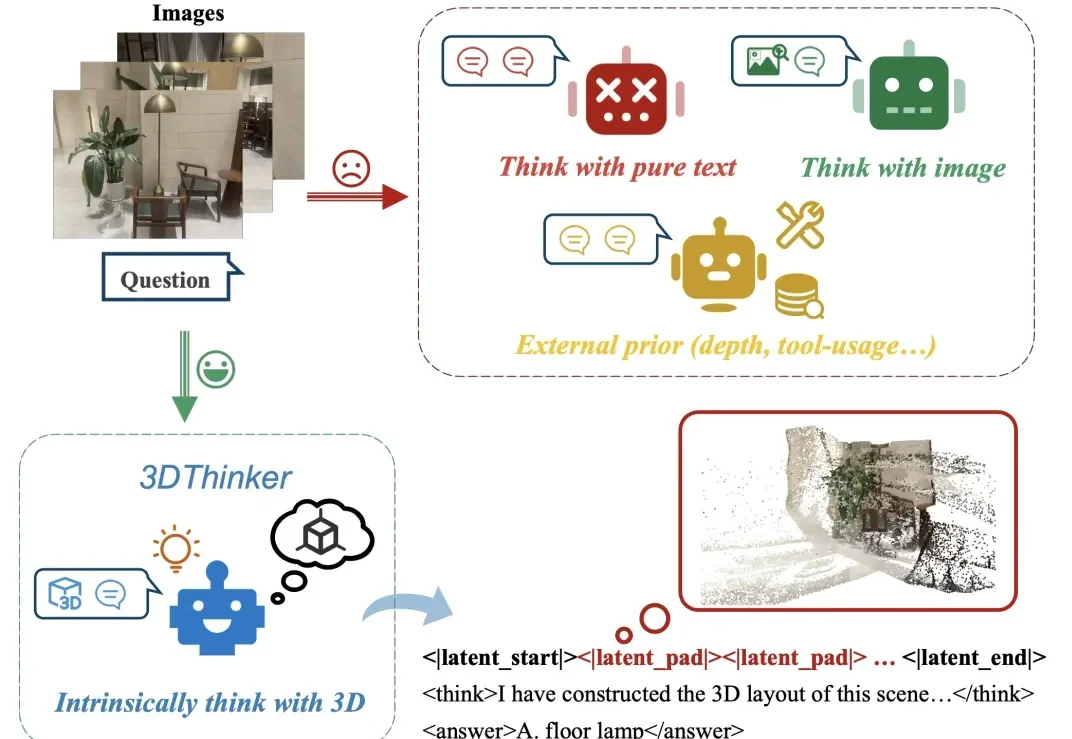

大家是否有这样的感觉?给定几张场景中拍摄的图片,往往能够在脑海中想象出这个场景的三维布局,然而当前的多模态大模型还停留于纯文本或者 2D 视觉的推理表示,限制了图像中隐含几何结构的表达能力。

用强化学习微调扩散模型,还有更好的办法吗?