马斯克、奥特曼X上再开撕,Ilya最新52页证词曝光,抖出OpenAI更多内幕

马斯克、奥特曼X上再开撕,Ilya最新52页证词曝光,抖出OpenAI更多内幕马斯克似乎并不想翻篇,转发了一位博主 po 出的 Ilya 最新证词的帖子,称这是「一个 52 页的故事」。在这份证词中,Ilya Sutskever 曝出了他围绕罢免 Sam Altman 所采取的关键行动。

马斯克似乎并不想翻篇,转发了一位博主 po 出的 Ilya 最新证词的帖子,称这是「一个 52 页的故事」。在这份证词中,Ilya Sutskever 曝出了他围绕罢免 Sam Altman 所采取的关键行动。

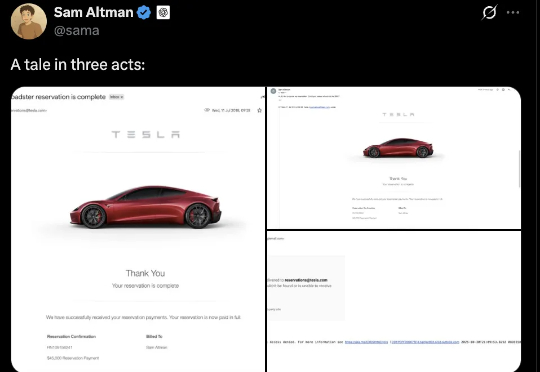

我深入研究了 Supermemory 的技术方案后,发现它和市面上其他记忆解决方案有本质区别。大多数所谓的"记忆"系统,本质上只是一个数据库,提供基本的增删改查功能。你可以保存一个实体,给它设定用户范围,然后查询出来。这很有用,但这只是基础功能,任何数据库都能做到。

2025 年被广泛视为 AI 走向深度应用的关键元年,在这一年里,以多模态生成、Agent 为代表的 AI 技术不断探索更多样、更高效、更贴合用户需求的应用形态。其中重要性愈加凸显的一点是:AI 正在走向产业级价值的系统性兑现。

一款由10人团队打造的AI助手Poke,颠覆了传统AI的“讨好”形象。用户必须先“说服”一个AI门卫才能加入,并且订阅价格需要像谈生意一样,与这个风趣的AI“讨价还价”才能敲定。

11月的第一天,一支12年周期的 AI Fund——「锦秋基金」办了一场 CEO 大会。

在大数据和大模型推动下,微调技术凭借成本低、效率高优势,成为应对小样本、长尾目标等复杂场景的利器。从早期全参数微调到参数高效微调(PEFT),再到如今融合多种PEFT技术的混合微调,遥感微调技术不断进化。清华大学等团队在CVMJ期刊上系统梳理了技术脉络,并指出了九个潜在研究方向,助力遥感技术在农业监测、天气预报等关键领域发挥更大作用。

前段时间某视频模型更新 2.0 的时候,写了一篇文章,其中提到了一个观点:用户不需要第二个 AI 视频的抖音。这次核心不是模型能力提升,不是 AI Feed 流,而是底层模型能力提升带来的全新「创意社交」玩法。

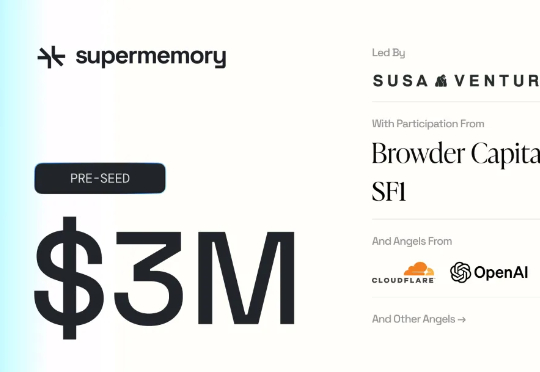

在 AI 多模态的发展历程中,OpenAI 的 CLIP 让机器第一次具备了“看懂”图像与文字的能力,为跨模态学习奠定了基础。如今,来自 360 人工智能研究院冷大炜团队的 FG-CLIP 2 正式发布并开源,在中英文双语任务上全面超越 MetaCLIP 2 与 SigLIP 2,并通过新的细粒度对齐范式,补足了第一代模型在细节理解上的不足。

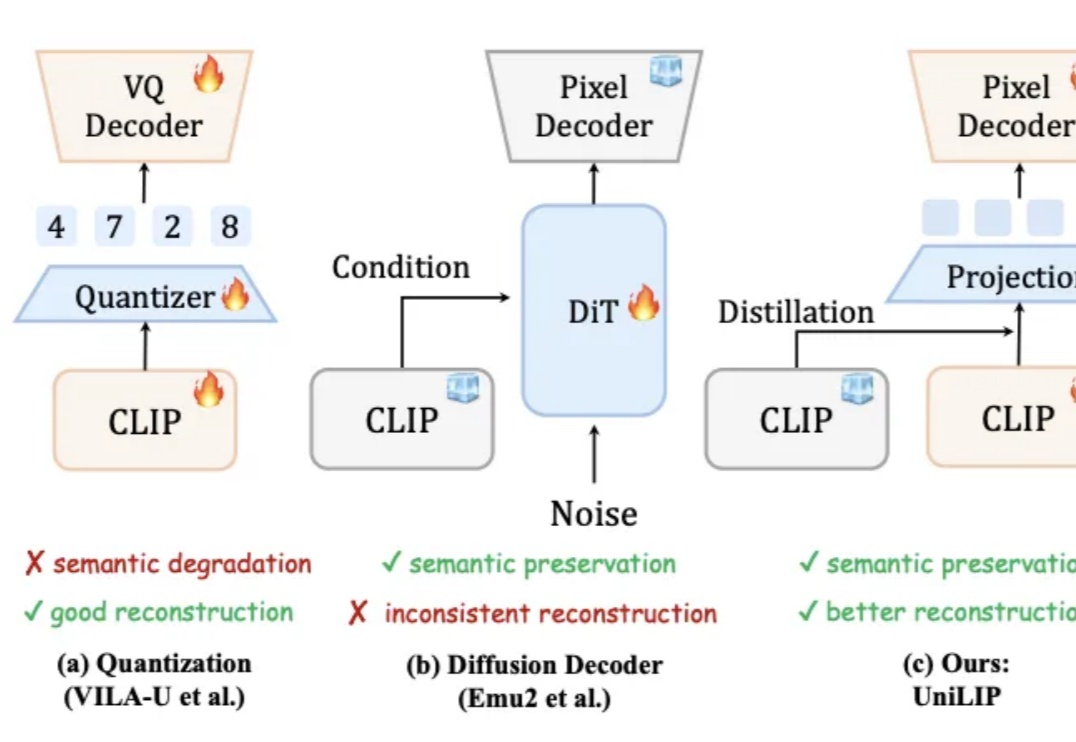

统一多模态模型要求视觉表征必须兼顾语义(理解)和细节(生成 / 编辑)。早期 VAE 因语义不足而理解受限。近期基于 CLIP 的统一编码器,面临理解与重建的权衡:直接量化 CLIP 特征会损害理解性能;而为冻结的 CLIP 训练解码器,又因特征细节缺失而无法精确重建。例如,RAE 使用冻结的 DINOv2 重建,PSNR 仅 19.23。

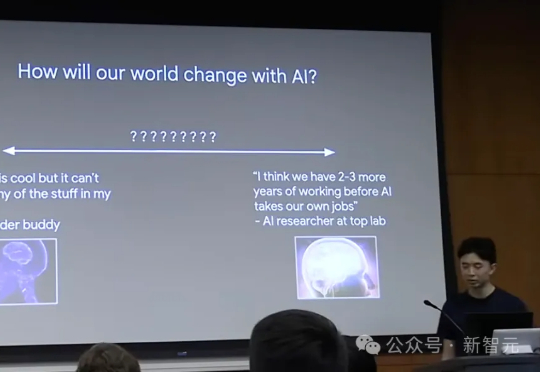

在AI加持下的这一年人类突飞猛进,停下来回头看去,似乎AI已经无所不能,但前OpenAI灵魂研究员认为AI不可能瞬间超越人类,他还提出了三个关于AI的最新洞见。所有能被验证的任务,最终都会被AI解决 智能最后会变成商品,知识价格归零 AI不会瞬间超过人类