综合RLHF、DPO、KTO优势,统一对齐框架UNA来了

综合RLHF、DPO、KTO优势,统一对齐框架UNA来了随着大规模语言模型的快速发展,如 GPT、Claude 等,LLM 通过预训练海量的文本数据展现了惊人的语言生成能力。然而,即便如此,LLM 仍然存在生成不当或偏离预期的结果。这种现象在推理过程中尤为突出,常常导致不准确、不符合语境或不合伦理的回答。为了解决这一问题,学术界和工业界提出了一系列对齐(Alignment)技术,旨在优化模型的输出,使其更加符合人类的价值观和期望。

随着大规模语言模型的快速发展,如 GPT、Claude 等,LLM 通过预训练海量的文本数据展现了惊人的语言生成能力。然而,即便如此,LLM 仍然存在生成不当或偏离预期的结果。这种现象在推理过程中尤为突出,常常导致不准确、不符合语境或不合伦理的回答。为了解决这一问题,学术界和工业界提出了一系列对齐(Alignment)技术,旨在优化模型的输出,使其更加符合人类的价值观和期望。

Transformer 的强大实力已经在诸多大型语言模型(LLM)上得到了证明,但该架构远非完美,也有很多研究者致力于改进这一架构,比如机器之心曾报道过的 Reformer 和 Infini-Transformer。

在人工智能领域掀起巨浪的 OpenAI o1 模型发布三周后,一支由高校年轻研究者组成的团队今天发布了题为 "o1 Replication Journey: A Strategic Progress Report (o1 探索之旅:战略进展报告)" 的研究进展报告。

众所周知,人类的本质是复读机。 我们遵循复读机的自我修养:敲黑板,划重点,重要的事情说三遍。 but,事实上同样的方法对付AI也有奇效!

会议组织者都是 NLP 头部科学家,在语言建模方面有着相当的成果。

Transformer计算,竟然直接优化到乘法运算了。MIT两位华人学者近期发表的一篇论文提出:Addition is All You Need,让LLM的能耗最高降低95%。

现实世界中的强化学习在应用过程中也面临着巨大的挑战,尤其是如何保证系统的安全性。为了解决这一问题,安全强化学习(Safe Reinforcement Learning, Safe RL)应运而生,成为当前学术界和工业界关注的焦点。

Mila、谷歌DeepMind和微软的研究团队近期联合发布了一项重要研究成果,揭示了LLM在推理能力上存在的显著差异。这项研究不仅挑战了我们对LLM推理能力的认知,也提醒我们在开发AI应用时,LLM的选择上要多考虑一些因素,尤其是需要注意Prompt的敏感性和一致性。

Goodfire于2024年在旧金山成立,研发用于提高生成式AI模型内部运作可观察性的开发工具,希望提高AI系统的透明度和可靠性,帮助开发者更好地理解和控制AI模型。

来自中国科学技术大学数据空间研究中心、香港科技大学、香港理工大学以及奥胡斯大学的研究者们提出一种新的场景生成方法 DreamScene,只需要提供场景的文本就可以生成高质量,视角一致和可编辑的 3D 场景。

chatGPT,AI,AI 3D,CE3D,扩散模型

视频生成领域真是越来越卷且越来越迈向实用性!

OpenAI的o1模型在通用语言任务上展现了显著的性能,最新测评展现了o1模型在医学领域的表现,主要关注理解、推理和多语言能力,结果大幅超越以往的模型!

是否还在苦恼于开源图生 / 文生三维模型无法直接嵌入到 CG 工作流中?是否在寻找具备高质量几何与物理材质的三维生成大模型?

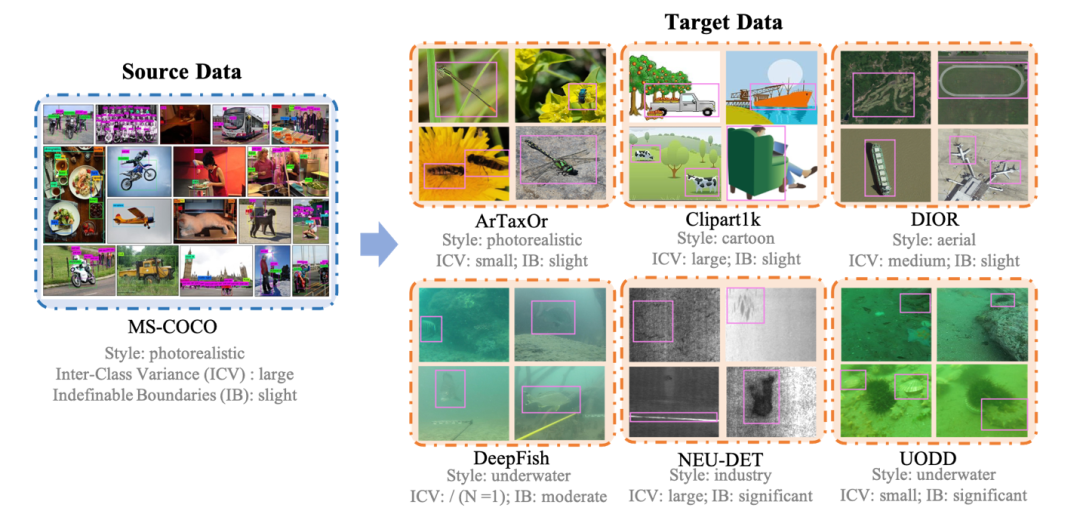

解决跨域小样本物体检测问题,入选ECCV 2024。

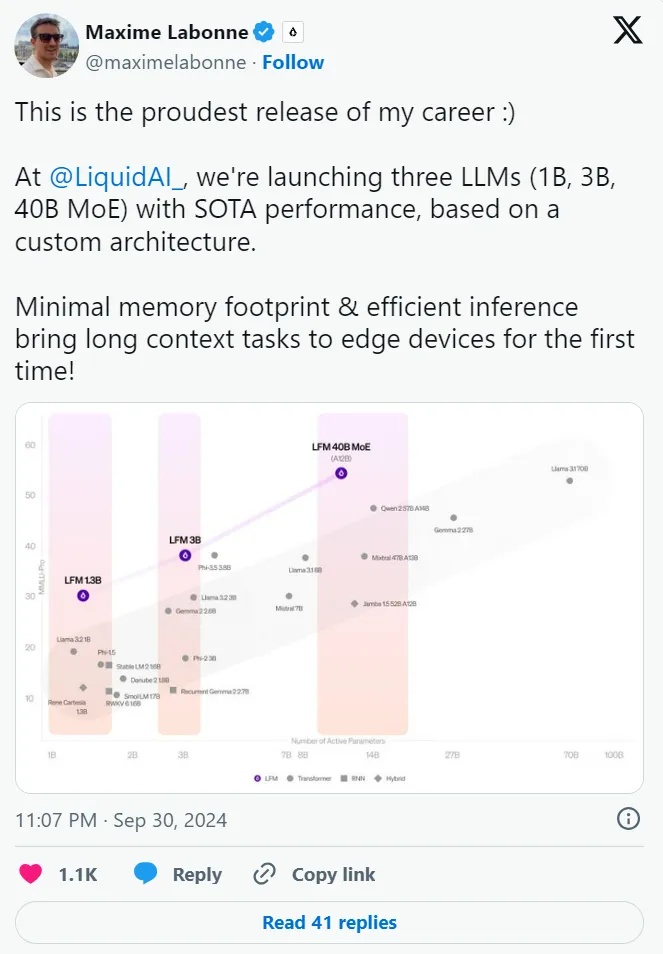

挑战Transformer,MIT初创团队推出LFM(Liquid Foundation Model)新架构模型爆火。

摩根大通(J.P. Morgan)在2024年9月发布“Investable AI Summary of J.P. Morgan research and industry developments in 2024”关于人工智能(AI)2024年的研究和行业发展总结。

在机器人研究领域,抓取任务始终是机器人操作中的一个关键问题。这项任务的核心目标是控制机械手移动到合适位置,并完成对物体的抓取。近年来,基于学习的方法在提高对不同物体的抓取的泛化能力上取得了显著进展,但针对机械手本身,尤其是复杂的灵巧手(多指机械手)之间的泛化能力仍然缺乏深入研究。由于灵巧手在不同形态和几何结构上存在显著差异,抓取策略的跨手转移一直存在挑战。

计算机科学、数学、自然科学、医学、语言学、社会科学……OpenAI o1擅长什么?还有哪些不足?

一个受线虫启发的全新架构,三大「杯型」均能实现 SOTA 性能,资源高度受限环境也能部署。移动机器人可能更需要一个虫子的大脑。

近日,北京大学陈宝权教授在第九届计算机图形学与混合现实研讨会(GAMES 2024)上,发表了题为《从图形计算到世界模型》的主旨报告,分享了他从图形仿真角度对世界模型的思考。本文是对陈教授报告的完整整理,以供大家学习。

在医疗领域中,大语言模型已经有了广泛的研究。然而,这些进展主要依赖于英语的基座模型,并受制于缺乏多语言医疗专业数据的限制,导致当前的医疗大模型在处理非英语问题时效果不佳。

在人工智能技术发展最快的美国,人们对生成式人工智能的使用情况怎样? 美国全国经济研究所(NBER)日前发布的最新一篇工作论文《The Rapid Adoption of Generative AI》给出了答案。NBER是美国最大的经济学研究组织,其发布的工作论文代表着经济学研究最新的成果。

想参加陶哲轩发起的「众包」数学研究项目吗? 机会来了!

NeurIPS 2024评审结果已经公布了! 收到邮件的小伙伴们,就像在开盲盒一样,纷纷在社交媒体上晒出了自己的成绩单。

NeurIPS 2024放榜,人大附中有高中生一作入选。

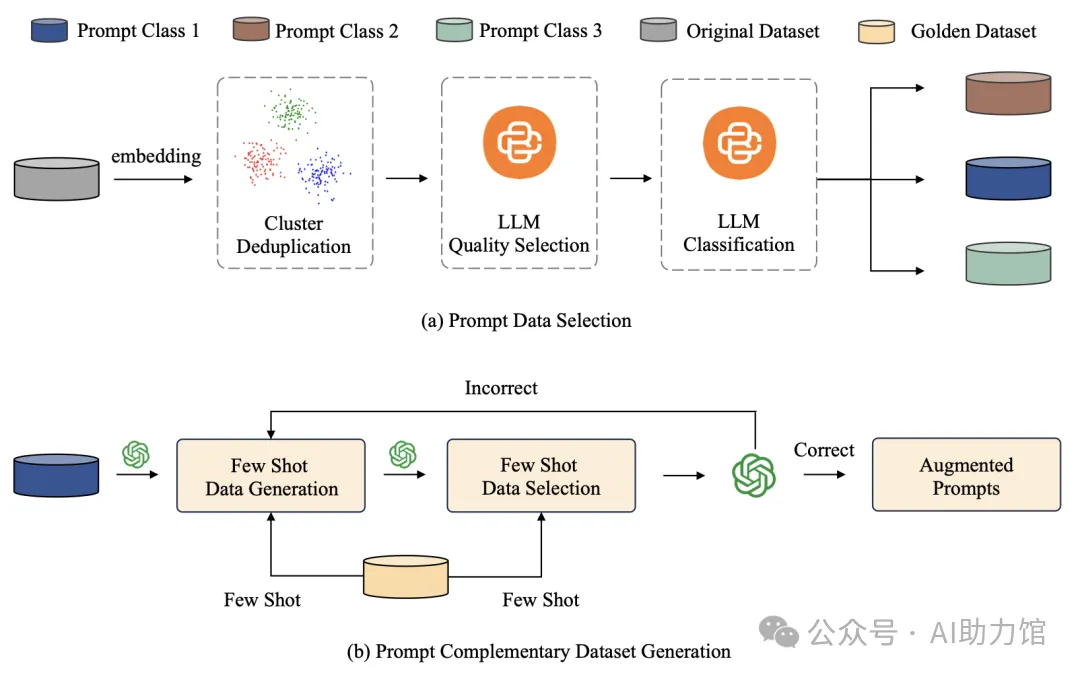

在人工智能的世界里,大型语言模型(LLM)已经成为我们探索未知、解决问题的得力助手。但是,你在编写AI提示词时,是否觉得这个过程就像在“炼丹”,既神秘又难以掌握?别担心,自动提示工程(APE)来帮你了!

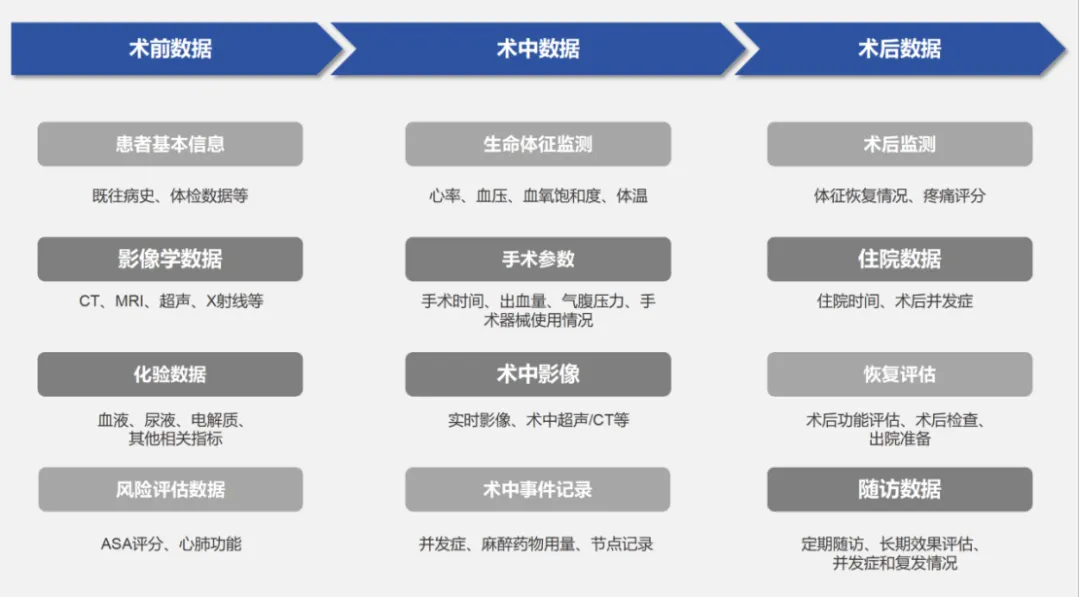

外科医生Dr. Lee在一次美敦力的学术讨论上说到,“外科医生和精英运动员非常相似,都在团队环境中工作,不断的重复训练已达到顶尖的成绩。但运动员往往花费更多的时间在影像室,回顾和研究过去的表现。而医生目前还没有得到足够、及时的信息反馈,以学习和提升手术技能。”

在这种背景下,研究团队提出了一个全新的框架:SubgoalXL,结合了子目标(subgoal)证明策略与专家学习(expert learning)方法,在 Isabelle 中实现了形式化定理证明的性能突破。

香港中文大学等机构的研究团队通过深度强化学习(DQN)开发了一种3D打印路径规划器,有效提升了打印效率和精度,为智能制造开辟了新途径。